編者按:本文首次出現在《Spektrum der Wissenschaft》(《大眾科學》的姊妹刊物)上,標題為“Digitale Demokratie statt Datendiktatur”。

“啟蒙運動是人類擺脫自我強加的不成熟狀態。不成熟是指在沒有他人指導的情況下無法運用自己的理解力。”

——伊曼努爾·康德,《什麼是啟蒙運動?》(1784)

關於支援科學新聞業

如果您喜歡這篇文章,請考慮透過以下方式支援我們屢獲殊榮的新聞報道 訂閱。透過購買訂閱,您正在幫助確保未來能夠繼續講述關於塑造我們當今世界的發現和思想的有影響力的故事。

數字革命正在如火如荼地進行。它將如何改變我們的世界?我們產生的資料量每年翻一番。換句話說:2016年,我們產生的資料量相當於人類有史以來到2015年為止產生的資料量總和。每分鐘,我們產生數十萬次的谷歌搜尋和Facebook帖子。這些內容包含的資訊揭示了我們的思考和感受。很快,我們周圍的事物,甚至可能是我們的衣服,也將與網際網路連線起來。據估計,10年後,將有1500億個聯網測量感測器,是地球上人口的20倍。屆時,資料量將每12小時翻一番。許多公司已經在嘗試將這些大資料轉化為鉅額財富。

一切都將變得智慧化;很快我們將不僅擁有智慧手機,還將擁有智慧家居、智慧工廠和智慧城市。我們是否也應該期待這些發展會帶來智慧國家和更智慧的地球?

人工智慧領域確實正在取得驚人的進步。特別是,它正在為資料分析的自動化做出貢獻。人工智慧不再逐行程式設計,而是現在能夠學習,從而不斷發展自身。最近,谷歌的DeepMind演算法自學瞭如何贏得49個Atari遊戲。演算法現在可以像人類一樣出色地識別手寫語言和模式,甚至在某些任務中比人類做得更好。它們能夠描述照片和影片的內容。如今,70%的金融交易是由演算法完成的。新聞內容也在部分程度上自動生成。這一切都具有 радикальные 經濟後果:在未來10到20年內,今天大約一半的工作崗位將受到演算法的威脅。今天排名前500強的公司中,有40%將在十年內消失。

可以預見的是,超級計算機很快將在幾乎所有領域超越人類的能力——大約在2020年到2060年之間。專家們開始敲響警鐘。技術遠見家,如特斯拉汽車的埃隆·馬斯克、微軟的比爾·蓋茨和蘋果聯合創始人史蒂夫·沃茲尼亞克,都在警告說,超級智慧對人類來說是一個嚴重的危險,可能比核武器更危險。

這是危言聳聽嗎?

有一點是明確的:我們組織經濟和社會的方式將發生根本性的變化。我們正在經歷自第二次世界大戰結束以來最大的轉型;繼生產自動化和自動駕駛汽車的創造之後,社會自動化即將到來。由此,社會正處於一個十字路口,這既帶來了巨大的機遇,也帶來了相當大的風險。如果我們做出錯誤的決定,可能會威脅到我們最偉大的歷史成就。

在20世紀40年代,美國數學家諾伯特·維納(1894-1964)發明了控制論。根據他的說法,系統的行為可以透過適當的反饋手段來控制。很快,一些研究人員設想根據這一基本原則來控制經濟和社會,但當時必要的技術尚不可用。

今天,新加坡被視為資料控制社會的完美典範。最初旨在保護公民免受恐怖主義侵害的專案最終影響了經濟和移民政策、房地產市場和學校課程。中國正在採取類似的路線。最近,百度(中國的谷歌)邀請軍方參與中國大腦計劃。該計劃涉及在其使用者收集的搜尋引擎資料上執行所謂的深度學習演算法。除此之外,還計劃進行某種形式的社會控制。據最近的報道,每位中國公民都將獲得所謂的“公民評分”,這將決定他們在什麼條件下可以獲得貸款、工作或前往其他國家的旅行簽證。這種個人監控將包括人們的網際網路衝浪和社交聯絡人的行為(參見“聚焦中國”)。

隨著消費者面臨越來越頻繁的信用檢查,以及一些線上商店嘗試個性化定價,我們在西方也走在類似的道路上。我們也越來越清楚地意識到,我們都處於機構監控的焦點之下。這一點在2015年英國軍情五處的“卡瑪警察”計劃的細節公開時被揭露,該計劃顯示了對每個人網際網路使用的全面篩查。老大哥現在要變成現實了嗎?

程式化社會,程式化公民

一切都始於相當無害。搜尋引擎和推薦平臺開始為我們提供個性化的產品和服務建議。這些資訊基於從之前的搜尋、購買和出行行為以及社互動動中收集到的個人和元資料。雖然官方上使用者的身份受到保護,但在實踐中,它可以很容易地被推斷出來。如今,演算法非常清楚我們做什麼、想什麼和感受什麼——甚至可能比我們的朋友和家人,甚至我們自己更清楚。通常,我們得到的推薦非常合適,以至於由此產生的決定感覺好像是我們自己的決定,即使它們實際上不是我們的決定。事實上,我們正以這種方式越來越成功地被遠端控制。關於我們知道的越多,我們的選擇就越不可能自由,而不是由他人預先決定的。

但這不會止步於此。一些軟體平臺正在轉向“說服性計算”。未來,利用複雜的操縱技術,這些平臺將能夠引導我們完成整個行動過程,無論是執行復雜的工作流程,還是為網際網路平臺生成免費內容,而企業從中賺取數十億美元。趨勢是從程式設計計算機到程式設計人類。

這些技術在政治領域也變得越來越流行。在“助推”的標籤下,並且大規模地,政府正試圖透過“助推”——一種現代形式的家長式作風——引導公民走向更健康或更環保的行為。新的、關懷型的政府不僅對我們做什麼感興趣,還想確保我們做它認為正確的事情。神奇的短語是“大資料助推”,它是大資料與助推的結合。在許多人看來,這似乎是一種數字權杖,可以讓人有效地統治大眾,而無需讓公民參與民主程序。這能否克服既得利益並最佳化世界程序?如果是這樣,那麼公民就可以由資料賦能的“賢明國王”統治,他幾乎可以用數字魔杖產生期望的經濟和社會結果。

預先程式設計的災難

但看一下相關的科學文獻就會發現,從“最佳化”的意義上來說,控制輿論的嘗試註定會失敗,因為問題太複雜了。輿論形成的動態充滿了意外。沒有人知道數字魔杖,也就是操縱性的助推技術,應該如何最好地使用。什麼是正確或錯誤的措施,往往只有事後才顯而易見。例如,在2009年德國豬流感流行期間,每個人都被鼓勵去接種疫苗。然而,我們現在知道,一定比例的接種疫苗的人受到了一種不尋常的疾病——嗜睡症的影響。幸運的是,選擇接種疫苗的人沒有更多!

另一個例子是最近健康保險提供商試圖透過發放智慧健身手環來鼓勵增加運動量,目的是減少人群中的心血管疾病;但最終,這可能會導致更多的髖關節手術。在像社會這樣的複雜系統中,一個領域的改善幾乎不可避免地會導致另一個領域的惡化。因此,大規模的干預有時可能被證明是巨大的錯誤。

無論如何,罪犯、恐怖分子和極端分子遲早會設法控制數字魔杖——甚至可能在我們沒有注意到的情況下。幾乎所有公司和機構都已被駭客入侵,甚至包括五角大樓、白宮和國家安全域性。

當缺乏足夠的透明度和民主控制時,還會出現另一個問題:系統從內部受到侵蝕。搜尋演算法和推薦系統可以被影響。公司可以競標某些詞語組合以獲得更有利的結果。政府也可能能夠影響結果。在選舉期間,他們可能會引導未決定的選民支援他們——這種操縱將很難被發現。因此,誰控制了這項技術,誰就可以贏得選舉——透過助推自己上臺。

在許多國家,單一搜索引擎或社交媒體平臺佔據主導市場份額,這加劇了這個問題。它可以決定性地影響公眾並遠端干預這些國家。即使歐洲法院於2015年10月6日作出的判決限制了歐洲資料的無限制出口,但根本問題在歐洲境內仍未解決,在其他地方更是如此。

我們可以預期哪些不良副作用?為了使操縱不被察覺,它需要所謂的共鳴效應——足夠為每個人定製的建議。透過這種方式,區域性趨勢透過重複逐漸加強,一直導致“過濾器氣泡”或“迴音室效應”:最終,您可能得到的所有資訊都是您自己意見的反映。這會導致社會兩極分化,導致形成不再相互理解並發現自己越來越相互衝突的獨立群體。透過這種方式,個性化資訊可能會在無意中破壞社會凝聚力。目前在美國政治中可以觀察到這一點,民主黨人和共和黨人之間的分歧越來越大,以至於政治妥協幾乎變得不可能。結果是社會的分裂,甚至可能是解體。

由於共鳴效應,社會輿論的大規模改變只能緩慢而逐漸地產生。影響會滯後出現,而且也不容易撤銷。例如,對少數族裔或移民的怨恨可能會失控;過多的民族主義情緒可能會導致歧視、極端主義和衝突。

也許更重要的是,操縱方法改變了我們做出決定的方式。它們至少暫時地推翻了原本相關的文化和社會線索。總而言之,大規模使用操縱方法可能會造成嚴重的社會損害,包括數字世界中行為的野蠻化。誰應該對此負責?

法律問題

這引發了法律問題,鑑於過去幾年對菸草公司、銀行、IT和汽車公司處以鉅額罰款,這些問題不應被忽視。但是,如果存在違法行為,哪些法律可能被違反了?首先,很明顯,操縱技術限制了選擇自由。如果我們對我們行為的遠端控制能夠完美地工作,我們本質上將成為數字奴隸,因為我們將只執行實際上是其他人預先做出的決定。當然,操縱技術只是部分有效。儘管如此,我們的自由正在緩慢但肯定地消失——事實上,消失得足夠緩慢,以至於到目前為止,民眾幾乎沒有抵抗。

偉大的啟蒙思想家伊曼努爾·康德的見解似乎在這裡非常相關。其中,他指出,試圖決定公民幸福的國家是暴君。然而,個人自我發展的權利只能由那些能夠控制自己生活的人行使,這預設了資訊自決權。這關係到我們最重要的憲法權利。除非這些權利得到尊重,否則民主制度就無法良好運作。如果這些權利受到限制,這將破壞我們的憲法、我們的社會和國家。

由於像大資料助推這樣的操縱技術的功能與個性化廣告類似,因此其他法律也受到影響。廣告必須標明為廣告,並且不得具有誤導性。它們也不允許利用某些心理技巧,例如閾下刺激。這就是為什麼禁止在電影中以一閃而過的時間顯示軟飲料,因為這樣廣告就不會被有意識地感知到,但它可能仍然具有潛意識的影響。此外,當前廣泛收集和處理個人資料的行為當然與歐洲國家和其他地方適用的資料保護法不符。

最後,個性化定價的合法性值得懷疑,因為它可能是濫用內幕資訊。其他相關方面是可能違反平等和不歧視原則,以及違反競爭法,因為自由市場準入和價格透明度不再得到保證。這種情況類似於企業在其他國家以更低的價格銷售其產品,但試圖阻止透過這些國家購買。過去,此類案件已導致高額懲罰性罰款。

個性化廣告和定價不能與傳統廣告或折扣券相提並論,因為後者是非特定的,也沒有侵犯我們的隱私,其目的是利用我們的心理弱點並擊潰我們的批判性思維。

此外,我們不要忘記,在學術界,即使是無害的決策實驗也被認為是人體實驗,必須經過公眾問責的倫理委員會的批准。在每種情況下,相關人員都需要給出知情同意。相比之下,單擊一下以確認我們同意一百頁“使用條款”協議的內容(這在當今許多資訊平臺上都是如此)是遠遠不夠的。

儘管如此,操縱技術(如助推)的實驗正在數百萬人身上進行,沒有告知他們,沒有透明度,也沒有道德約束。即使是像Facebook這樣的大型社交網路或像OkCupid這樣的線上約會平臺也已經公開承認進行過這類社會實驗。如果我們想避免對人類和社會進行不負責任的研究(想想心理學家最近參與的酷刑醜聞),那麼我們迫切需要施加高標準,特別是科學質量標準和類似於希波克拉底誓言的行為準則。我們的思想、我們的自由、我們的民主制度是否已被駭客入侵?

讓我們假設存在一臺具有神一般的知識和超人能力的超級智慧機器:我們會聽從它的指示嗎?這似乎是可能的。但如果我們這樣做,那麼埃隆·馬斯克、比爾·蓋茨、史蒂夫·沃茲尼亞克、斯蒂芬·霍金等人表達的警告就會成真:計算機將控制世界。我們必須清楚,超級智慧也可能犯錯、撒謊、追求自私的利益或被操縱。最重要的是,它無法與全體人口的分散式集體智慧相提並論。

用計算機叢集取代所有公民的思考的想法是荒謬的,因為這將大大降低可實現解決方案的多樣性和質量。已經很明顯,儘管最近資料激增和個性化資訊的使用,世界問題並沒有減少——恰恰相反!世界和平是脆弱的。氣候的長期變化可能導致自恐龍滅絕以來最大的物種滅絕。我們也遠未克服金融危機及其對經濟的影響。據估計,網路犯罪每年造成3萬億美元的損失。國家和恐怖分子正在為網路戰做準備。

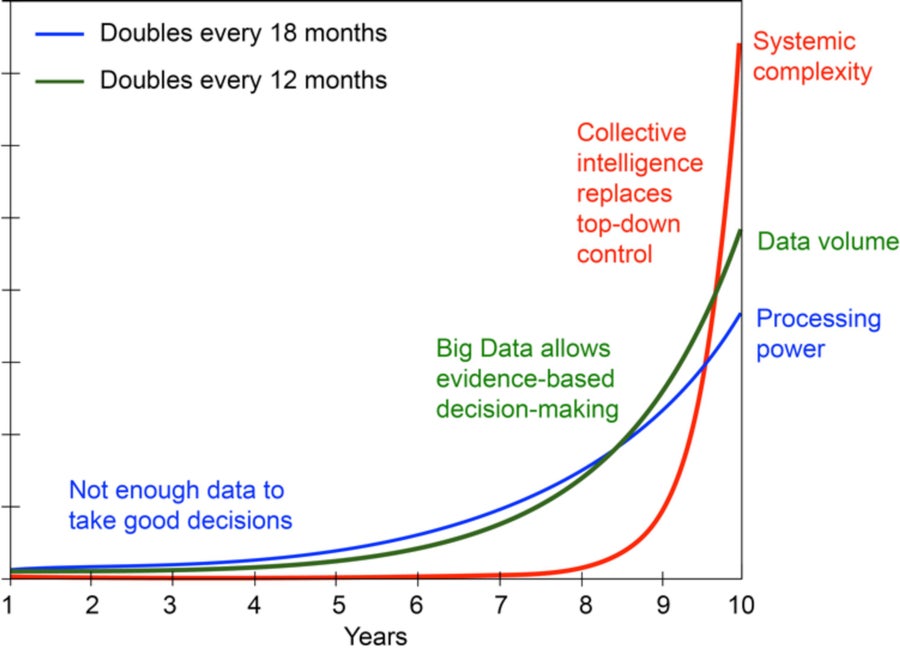

在一個瞬息萬變的世界中,超級智慧永遠無法做出完美的決定(見圖1):系統複雜性增長速度快於資料量,而資料量增長速度快於處理它們的能力,並且資料傳輸速率受到限制。這導致無視對達成良好解決方案很重要的當地知識和事實。分散式、本地控制方法通常優於集中式方法,尤其是在行為高度可變、難以預測且無法即時最佳化的複雜系統中。這對於城市交通控制來說已經是真的,但對於我們高度聯網的全球化世界的社會和經濟系統來說更是如此。

此外,強大的演算法操縱決策存在破壞“集體智慧”基礎的危險,“集體智慧”可以靈活地適應我們複雜世界的挑戰。為了使集體智慧發揮作用,個人的資訊搜尋和決策必須獨立進行。然而,如果我們的判斷和決定是由演算法預先決定的,那麼這確實會導致對人民的洗腦。智慧生物被降級為僅僅是命令的接收者,他們自動響應刺激。

換句話說:個性化資訊在我們周圍建立了一個“過濾器氣泡”,一種數字思維監獄。在這種條件下,創造力和“跳出框框”的思考怎麼可能實現?最終,使用超級智慧資訊系統對行為和社會進行集中式技術官僚控制的系統將導致一種新型的獨裁統治。因此,在“自由家長式作風”旗幟下的自上而下的控制型社會,原則上只不過是一個帶有玫瑰色外衣的極權主義政權。

事實上,大資料助推旨在使許多人的行為保持一致,並操縱他們的觀點和決定。這使其進入了宣傳和透過行為控制有針對性地削弱公民能力的領域。我們預計,從長遠來看,後果將是致命的,尤其是在考慮到上述破壞文化的影響時。

一個更美好的數字社會是可能的

儘管全球競爭激烈,但民主國家明智的做法是不拋棄幾個世紀以來的成就。與其他政治制度相比,西方民主國家的優勢在於它們已經學會了應對多元化和多樣性。現在他們只需要學習如何更好地利用它們。

未來,那些在商業、政府和公民之間達到健康平衡的國家將處於領先地位。這需要網路化思維和建立資訊、創新、產品和服務“生態系統”。為了良好地運作,不僅要創造參與機會,還要支援多樣性,這一點也很重要。因為沒有辦法確定最佳目標函式:我們應該最佳化人均國民生產總值還是可持續性?權力還是和平?幸福還是預期壽命?通常,什麼是更好,只有事後才知道。透過允許追求各種不同的目標,多元化的社會能夠更好地應對未來各種意想不到的挑戰。

集中式、自上而下的控制是過去的解決方案,僅適用於低複雜度的系統。因此,聯邦制和多數人決策是當前的解決方案。隨著經濟和文化的發展,社會複雜性將繼續上升。因此,未來的解決方案是集體智慧。這意味著公民科學、眾包和線上討論平臺是極為重要的新方法,可以提供更多的知識、想法和資源。

集體智慧需要高度的多樣性。然而,今天個性化的資訊系統正在減少這種多樣性,這些系統強化了趨勢。

社會多樣性與生物多樣性一樣重要。它不僅促進了集體智慧和創新,還促進了韌性——我們社會應對意外衝擊的能力。減少社會多樣性通常也會降低經濟和社會的功能和績效。這就是為什麼極權主義政權經常與鄰國發生衝突的原因。典型的長期後果是政治不穩定和戰爭,這在歷史上一次又一次地發生。

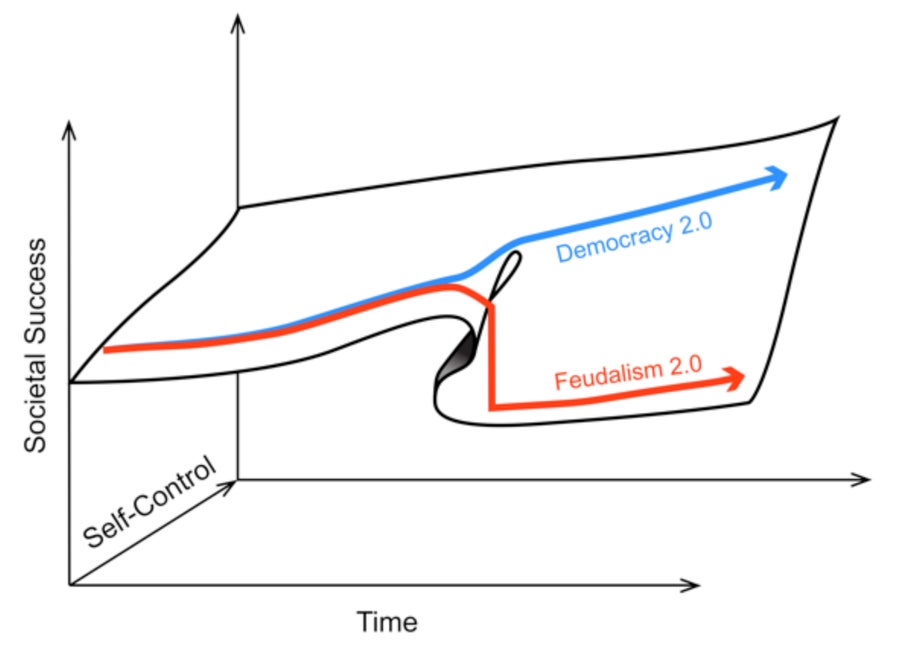

總而言之,可以說我們現在正處於一個十字路口(見圖2)。大資料、人工智慧、控制論和行為經濟學正在塑造我們的社會——無論好壞。如果如此廣泛的技術與我們社會的核心價值觀不相容,遲早會造成廣泛的損害。它們可能導致具有極權主義特徵的自動化社會。在最壞的情況下,集中式人工智慧將控制我們所知道的、我們所想的和我們所做的。我們正處於歷史性的時刻,我們必須決定正確的道路——一條讓我們所有人都能從數字革命中受益的道路。因此,我們敦促遵守以下基本原則

1. 逐步下放資訊系統的功能;

2. 支援資訊自決和參與;

3. 提高透明度,以實現更大的信任;

4. 減少資訊的扭曲和汙染;

5. 啟用使用者控制的資訊過濾器;

6. 支援社會和經濟多樣性;

7. 改進互操作性和協作機會;

8. 建立數字助理和協調工具;

9. 支援集體智慧,以及

10. 透過數字素養和啟蒙運動,促進公民在數字世界中的負責任行為。

遵循這一數字議程,我們所有人都將從數字革命的成果中受益:經濟、政府和公民都將如此。我們還在等什麼?

數字時代的戰略

大資料和人工智慧無疑是重要的創新。它們具有巨大的潛力,可以促進經濟價值和社會進步,從個性化醫療保健到可持續城市。然而,利用這些技術削弱公民的能力是完全不可接受的。大資料助推和公民評分濫用集中收集的個人資料進行行為控制,其本質是極權主義的。這不僅與人權和民主原則不相容,而且也不適合管理現代創新型社會。為了解決世介面臨的真正問題,需要在資訊和風險管理領域採取更好的方法。負責任的創新研究領域和“為了人類的資料”倡議(參見“為了社會和人類利益的大資料”)為如何為社會利益使用大資料和人工智慧提供了指導。

我們現在可以做什麼?首先,即使在數字革命時代,公民的基本權利也應受到保護,因為它們是現代功能完善的民主社會的基本前提。這需要建立一個新的社會契約,該契約基於信任與合作,將公民和客戶視為合作伙伴,而不是障礙或可剝削的資源。為此,國家將必須提供適當的監管框架,以確保技術的設計和使用方式與民主制度相容。這將必須保證資訊自決權,不僅在理論上,而且在實踐中也是如此,因為這是我們以自我決定和負責任的方式過上生活的前提。

還應該有權獲得關於我們收集的個人資料的副本。應該透過法律規定,這些資訊必須以標準化格式自動傳送到個人資料儲存庫,個人可以透過該儲存庫管理其資料的使用(可能由特定的基於人工智慧的數字助理支援)。為了確保更大的隱私並防止歧視,未經授權使用資料應受到法律懲罰。然後,個人將能夠決定誰可以使用他們的資訊、用於什麼目的以及使用多長時間。此外,應採取適當措施,確保資料得到安全儲存和交換。

考慮到多個標準的複雜聲譽系統可以幫助提高我們決策所依據的資訊質量。如果資料過濾器以及推薦和搜尋演算法可以由使用者選擇和配置,我們可以從多個角度看待問題,並且我們不太容易受到扭曲資訊的操縱。

此外,我們需要為公民建立有效的投訴程式,以及對違反規則的行為進行有效制裁。最後,為了建立足夠的透明度和信任,領先的科研機構應充當目前逃避民主控制的資料和演算法的受託人。這也需要適當的行為準則,至少任何可以訪問敏感資料和演算法的人都必須遵守該準則——一種針對IT專業人員的希波克拉底誓言。

此外,我們需要一項數字議程,為新的就業機會和數字社會的未來奠定基礎。每年,我們都會在農業部門和公共基礎設施、學校和大學投入數十億美元——這有利於工業和服務業。

因此,我們需要哪些公共系統來確保數字社會取得成功?首先,需要全新的教育理念。這應該更多地關注批判性思維、創造力、創造性和創業精神,而不是培養標準化工人(他們的任務在未來將由機器人和計算機演算法完成)。教育還應提供對數字技術的負責任和批判性使用的理解,因為公民必須意識到數字世界是如何與物理世界交織在一起的。為了有效和負責任地行使他們的權利,公民必須瞭解這些技術,以及哪些用途是不合法的。這就是為什麼科學、工業、政治和教育機構比以往任何時候都更需要廣泛普及這些知識。

其次,需要一個參與式平臺,使人們更容易成為個體經營者,建立自己的專案,尋找合作伙伴,在全球範圍內銷售產品和服務,管理資源並繳納稅款和社會保障金(一種面向所有人的共享經濟)。為了補充這一點,城鎮甚至鄉村都可以建立新興數字社群中心(如創客實驗室),在那裡可以免費共同開發和測試想法。由於在這些中心發現的開放和創新方法,大規模的協作創新可以得到促進。

特定型別的競賽可以為創新提供額外的激勵,幫助提高公眾知名度,併為參與式數字社會創造勢頭。它們在動員公民社會以確保為解決全球問題做出本地貢獻方面特別有用(例如,透過“氣候奧運會”)。例如,旨在協調稀缺資源的平臺可以幫助釋放迴圈和共享經濟的巨大潛力,而這些潛力在很大程度上仍未得到開發。

透過對開放資料戰略的承諾,政府和產業界將越來越多地向科學界和公眾開放資料,為高效的資訊和創新生態系統創造合適的條件,使其與我們世界的挑戰保持同步。這可以透過減稅來鼓勵,就像某些國家為使用環保技術而提供的減稅一樣。

第三,建立由公民執行的“數字神經系統”可以為每個人開啟物聯網的新機遇,並提供所有人都可以使用的即時資料測量。如果我們想以更可持續的方式利用資源並減緩氣候變化,我們需要衡量我們與他人和環境互動的正面和負面影響。透過使用適當的反饋迴圈,可以以這樣一種方式影響系統,使其透過自組織來實現期望的結果。

為了使之成功,我們需要各種激勵和交換系統,所有經濟、政治和社會創新者都可以使用。這可以創造全新的市場,並因此也為新的繁榮奠定基礎。多元化的金融體系(例如,功能差異化的貨幣)和新的發明報酬法規將極大地促進數字經濟的幾乎無限的潛力。

為了更好地應對我們未來世界的複雜性和多樣性,並將其轉化為優勢,我們將需要個人數字助理。這些數字助理也將受益於人工智慧領域的發展。未來,可以預期,根據需要,將靈活地構建和重新配置大量結合人類和人工智慧的網路。然而,為了使我們能夠保留對我們生活的控制權,這些網路應該以分散式方式進行控制。特別是,人們還必須能夠根據需要登入和登出。

民主平臺

“文化維基百科”最終可以幫助協調高度多樣化世界中的各種活動,並使它們彼此相容。它將使世界文化的絕大多數隱性成功原則顯性化,以便可以將它們以新的方式組合起來。像這樣的“文化基因組計劃”也將是一種和平專案,因為它將提高公眾對社會文化多樣性價值的認識。全球公司早就知道,文化多元化和多學科的團隊比同質化的團隊更成功。然而,在許多地方仍然缺少有效地整理來自大量人員的知識和想法以創造集體智慧所需的框架。為了改變這一點,提供線上審議平臺將非常有用。它們還可以建立實現升級的數字民主制度所需的框架,為公民提供更大的參與機會。這很重要,因為當今世介面臨的許多問題只能透過公民社會的貢獻來解決。

延伸閱讀

ACLU:奧威爾式公民評分,中國的信用評分系統,是對美國人的警告,http://www.computerworld.com/article/2990203/security/aclu-orwellian-citizen-score-chinas-credit-score-system-is-a-warning-for-americans.html

大資料,遇見老大哥:中國發明瞭數字極權主義國家。其社會信用專案的令人擔憂的含義。《經濟學人》(2016年12月17日)。

哈里斯,S. 社會實驗室,《外交政策》(2014年7月29日),http://foreignpolicy.com/2014/07/29/the-social-laboratory/

童,V.J.C. 預測人們如何思考和行為,《國際創新》,http://www.internationalinnovation.com/predicting-how-people-think-and-behave/

Volodymyr, M., Kavukcuoglu, K., Silver, D., et al.: 透過深度強化學習實現人類水平的控制。載於:《自然》,518,S. 529-533,2015。

Frey, B. S. 和 Gallus, J.: 有益的和剝削性的助推。載於:歐洲法學學術中的法律經濟分析。施普林格出版社,2015年。

Gigerenzer, G.: 關於自由意志家長主義的所謂證據。載於:《哲學與心理學評論》6(3),頁碼 361-383,2015年。

Grassegger, H. 和 Krogerus, M. 我只是表明炸彈是存在的 [I have only shown the bomb exists]。 《Das Magazin》(2016年12月3日)https://www.dasmagazin.ch/2016/12/03/ich-habe-nur-gezeigt-dass-es-die-bombe-gibt/

Hafen, E., Kossmann, D. 和 Brand, A.: 健康資料合作社——公民賦權。載於:《醫學資訊方法》53(2),頁碼 82–86,2014年。

Helbing, D.: 社會自動化即將來臨:如何在數字革命中生存。CreateSpace出版社,2015年。

Helbing, D.: 前瞻性思考——關於大資料、數字革命和參與式市場社會的論文集。施普林格出版社,2015年。

Helbing, D. 和 Pournaras, E.: 構建數字民主。載於:《自然》527,頁碼 33-34,2015年。

van den Hoven, J., Vermaas, P.E. 和 van den Poel, I.: 倫理學、價值觀和技術設計手冊。施普林格出版社,2015年。

Zicari, R. 和 Zwitter, A.: 為了人類的資料:一封公開信。法蘭克福大資料實驗室,2015年7月13日。 Zwitter, A.: 大資料倫理。載於:《大資料與社會》1(2),2014年。

圖 1: 數字增長。來源:Dirk Helbing

感謝大資料,我們現在可以做出更好、基於證據的決策。然而,自上而下的控制原則越來越失效,因為隨著我們不斷將世界網路化,社會的複雜性呈爆炸式增長。分散式控制方法將變得越來越重要。只有透過集體智慧,才有可能找到適當的解決方案來應對我們世界的複雜性挑戰。

圖 2: 數字十字路口。來源:Dirk Helbing

我們的社會正處於十字路口:如果越來越強大的演算法被少數決策者控制,並削弱我們的自主性,我們將倒退到封建主義 2.0,重要的歷史成就將喪失。然而,現在我們有機會選擇通往數字民主或民主 2.0 的道路,這將使我們所有人受益(另見 https://vimeo.com/147442522 )。

聚焦中國:這就是社會未來的樣子嗎?

行為和社會控制將如何影響我們的生活?公民評分的概念,目前正在中國實施,給出了一個想法。在那裡,所有公民都在一個一維排名尺度上進行評分。他們所做的一切都會給出加分或減分。這不僅針對大規模監控。分數取決於個人在網際網路上的點選和他們政治上是否正確的行為,它決定了他們的信貸條款、他們獲得某些工作的機會以及旅行簽證。因此,公民評分是關於行為和社會控制。甚至朋友和熟人的行為也會影響這個分數,即宗族連坐的原則也被應用:每個人都同時成為美德的守護者和一種窺探情報的線人;非正統的思想家被孤立。如果類似的原則在民主國家傳播,那麼最終無論是國家還是有影響力的公司制定規則,都將無關緊要。在這兩種情況下,民主的支柱都將受到直接威脅。

追蹤和測量所有留下數字痕跡的活動將創造一個“裸體”公民,他們的人格尊嚴和隱私將逐漸被 degradation(貶低/退化)。

決策將不再自由,因為從政府或公司定義積分系統標準的角度來看,錯誤的選擇會產生負面後果。個人的自主權原則上將被廢除。

每個小錯誤都會受到懲罰,沒有人會是清白的。無罪推定原則將變得過時。預測性警務甚至可能導致對尚未發生但僅僅是預期會發生的違規行為進行懲罰。

由於底層演算法無法完全無錯誤地執行,公平和正義的原則將被一種新的任意性所取代,人們幾乎無法為自己辯護。

如果個人目標是外部設定的,那麼個人自我發展的可能性將被消除,從而民主多元化也將被消除。

當地文化和社會規範將不再是適當的、情境依賴行為的基礎。

用一維目標函式控制社會將導致更多衝突,因此會導致安全喪失。人們將不得不預期嚴重的動盪,正如我們在金融系統中看到的那樣。

這樣控制社會將使社會從有責任感的公民轉向作為下屬的個人,導致封建主義 2.0。這與民主價值觀截然相反。因此,現在是啟蒙運動 2.0 的時候了,它將融入基於數字自決的民主 2.0。這需要民主技術:與民主原則相容的資訊系統——否則它們將摧毀我們的社會。

“大資料助推”——不適合解決問題

擁有大量資料的人可以巧妙地操縱人們。但即使是仁慈的決策者也可能弊大於利,Dirk Helbing 說。

助推的支持者認為,人們不會做出最優決策,因此有必要幫助他們。這種思維流派被稱為家長式作風。然而,助推並沒有選擇告知和說服人們的方式。它而是利用心理弱點來引導我們做出某些行為,也就是說,我們被欺騙了。這種方法背後的科學方法被稱為“行為主義”,實際上早已過時。

幾十年前,伯爾赫斯·弗雷德里克·斯金納透過獎勵和懲罰(例如,透過餵食或施加痛苦的電擊)來訓練老鼠、鴿子和狗。今天,人們試圖以類似的方式訓練人。我們不是生活在斯金納箱中,而是生活在“過濾器氣泡”中:透過個性化的資訊,我們的思維正在被引導。透過個性化的價格,我們甚至可能因(不)希望的網際網路點選而受到懲罰或獎勵。因此,助推與大資料的結合導致了一種新的助推形式,我們可以稱之為“大資料助推”。關於我們的個人資訊越來越多,這些資訊通常是在未經我們同意的情況下收集的,揭示了我們的想法、感受以及如何被操縱。這種內幕資訊被利用來操縱我們做出我們本來不會做出的選擇,購買一些價格過高的產品或我們不需要的產品,或者可能將我們的選票投給某個政黨。

然而,大資料助推不適合解決我們的許多問題。對於我們世界的複雜性相關挑戰尤其如此。儘管已經有 90 個國家使用助推,但它並沒有減少我們的社會問題——恰恰相反。全球變暖正在加劇。世界和平脆弱,恐怖主義正在抬頭。網路犯罪爆炸式增長,經濟和債務危機在許多國家也沒有得到解決。

對於金融市場的低效,也沒有解決方案,正如助推大師理查德·塞勒最近承認的那樣。他認為,如果國家控制金融市場,反而會加劇問題。但是,為什麼要以自上而下的方式控制我們的社會呢?社會比金融市場還要複雜。社會不是機器,複雜的系統不能像汽車一樣被操控。這可以透過討論另一個複雜系統來理解:我們的身體。要治癒疾病,需要在正確的時間以正確的劑量服用正確的藥物。許多治療方法也有嚴重的副作用和相互作用。當然,預計大資料助推對社會干預也會如此。通常事先不清楚什麼對社會有利或有害。心理學中 60% 的科學結果是無法重複的。因此,大資料助推很可能會弊大於利。

此外,沒有一種措施對所有人都有利。例如,在最近幾十年中,我們看到食品建議一直在變化。許多人也患有食物不耐受症,甚至可能是致命的。現在,人們對某些型別的癌症和其他疾病的大規模篩查持相當批判的態度,因為錯誤診斷的副作用往往大於益處。因此,如果決定使用大資料助推,那麼堅實的科學基礎、透明度、倫理評估和民主控制將至關重要。所採取的措施必須保證統計上顯著的改進,並且副作用必須是可以接受的。使用者應該被告知這些副作用(類似於醫療說明書),並且接受治療的人必須有最終決定權。

此外,對整個人口採用相同的措施是不好的。但是,對於採取適當的個人措施知之甚少。社會不僅要應用不同的治療方法以保持多樣性,而且相關性(關於在什麼特定情況下采取什麼措施)也很重要。對於社會的運作,至關重要的是人們應用不同的角色,這些角色適合他們所處的各自情況。大資料助推遠未能夠實現這一點。

當前基於大資料的個性化反而會產生新的問題,例如歧視。例如,如果我們使健康保險費率取決於某些飲食習慣,那麼猶太人、穆斯林和基督徒、婦女和男人將不得不支付不同的費率。因此,出現了一系列新問題。

因此,理查德·塞勒不厭其煩地強調,助推應該只以有益的方式使用。作為如何使用助推的一個主要例子,他提到了基於 GPS 的路線引導系統。然而,這是由使用者開啟和關閉的。使用者還指定了各自的目標。然後,數字助手提供幾種備選方案,使用者可以在其中自由選擇。之後,數字助手會盡其所能支援使用者實現目標並做出更好的決策。這當然是改善人們行為的正確方法,但是今天大資料助推的精神與此截然不同。

透過“複製權”實現數字自決

作者:Ernst Hafen

歐洲必須保障公民擁有所有關於他們的資料的數字副本的權利(複製權),Ernst Hafen 說。邁向資料民主的第一步是建立個人資料合作銀行,這些銀行由公民而非企業股東擁有。

醫學可以從健康資料中獲益。然而,對個人資料的訪問必須由個人(資料主體)自己控制。“複製權”構成了這種控制的基礎。

在歐洲,我們喜歡指出我們生活在自由、民主的社會中。然而,我們幾乎不自覺地依賴於跨國資料公司,我們用自己的資料為他們的免費服務付費。個人資料——現在有時被稱為“新的資產類別”或 21 世紀的石油——備受追捧。然而,到目前為止,還沒有人設法從個人資料中提取最大用途,因為它存在於許多不同的資料集中。谷歌和 Facebook 可能比我們的醫生更瞭解我們的健康狀況,但即使是這些公司也無法整理我們所有的資料,因為他們理所當然地無法訪問我們的病歷、購物收據或關於我們基因構成的的資訊。與其他資產不同,資料可以以幾乎零成本複製。每個人都應該有權獲得其所有個人資料的副本。透過這種方式,他們可以控制其資料的使用和聚合,並自行決定是否允許朋友、另一位醫生或科學界訪問。

移動健康感測器和應用程式的出現意味著患者可以貢獻重要的醫學見解。透過在智慧手機上記錄他們的身體健康狀況,例如醫學指標和藥物的副作用,他們提供了重要的資料,這些資料使得觀察治療方法的應用、評估健康技術以及普遍進行循證醫學成為可能。讓公民訪問其資料副本並允許他們參與醫學研究也是一種道德義務,因為它將拯救生命並使醫療保健更實惠。

歐洲國家應透過在其憲法中寫入“複製權”來鞏固公民的數字自決權,正如瑞士提出的那樣。透過這種方式,公民可以使用他們的資料在全球資料經濟中發揮積極作用。如果他們可以將資料副本儲存在非營利性、公民控制的合作機構中,那麼個人資料的很大一部分經濟價值可以迴歸社會。合作機構將充當受託人來管理其成員的資料。這將導致個人資料市場的民主化和數字依賴的終結。

民主數字社會

必須允許公民積極參與

為了以負責任的方式應對未來的技術,我們每個人都必須能夠參與決策過程,巴塞爾大學的Bruno S. Frey 認為。

如何有效地促進負責任的創新?如果塑造人際互動的制度或規則沒有被設計為激勵和使人們能夠滿足這些要求,那麼對公眾的呼籲幾乎沒有任何效果。

應考慮幾種型別的制度。最重要的是,社會必須去中心化,遵循輔助性原則。三個維度很重要。

空間去中心化包括充滿活力的聯邦制。各省、地區和市鎮必須被賦予充分的自主權。在很大程度上,他們必須能夠設定自己的稅率並管理自己的公共支出。

功能性去中心化根據公共支出的領域(例如教育、衛生、環境、供水、交通、文化等)也是可取的。這個概念是透過 FOCJ 的提議發展起來的,即“功能性、重疊和競爭性管轄區”。

政治去中心化涉及行政部門(政府)、立法部門(議會)和法院之間的權力劃分。公共媒體和學術界應成為額外的支柱。

這些型別的去中心化在未來的數字社會中將繼續具有重要意義。

此外,公民必須有機會透過全民公決直接參與特定問題的決策。在全民公決之前的討論中,應提出所有相關論點並以有組織的方式陳述。應該比較關於如何解決特定問題的各種提議,並將範圍縮小到那些似乎最有希望的提議,並在調解過程中儘可能地整合。最後,需要進行全民公決,以確定最適合當地情況的可行解決方案(可行性在於它在選民中享有廣泛的支援)。

如今,線上審議工具可以有效地支援這些過程。這使得考慮更廣泛和更多樣化的想法和知識成為可能,利用“集體智慧”來產生更好的政策建議。

實施這十項建議的另一種方法是建立新的、非正統的制度。例如,可以強制每個官方機構都聘請一位“魔鬼代言人”。這位橫向思維者將負責為每個提案開發反駁論據和替代方案。這將減少沿著“政治正確”路線思考的趨勢,並且還將考慮解決問題的非常規方法。

另一種非正統的措施是從討論過程中認為合理的備選方案中,使用隨機決策機制進行選擇。這種方法增加了非常規和通常被忽視的提案和想法被整合到未來數字社會中的機會。

Bruno S. Frey

Bruno Frey (* 1941) 是一位學術經濟學家,也是巴塞爾大學的常任客座教授,他在那裡指導經濟與福祉研究中心 (CREW)。他還是蘇黎世經濟、管理和藝術研究中心 (CREMA) 的研究主任。

民主技術與負責任的創新

當技術決定我們如何看待世界時,就存在濫用和欺騙的威脅。因此,創新必須反映我們的價值觀,Jeroen van den Hoven 認為。

德國最近被一場全球性的工業醜聞震驚。這一醜聞的曝光導致一家最大的汽車製造商的執行長辭職,消費者信心嚴重喪失,股價大幅下跌,並對整個汽車行業造成經濟損失。甚至有人談到對“德國製造”品牌造成嚴重損害。賠償金將達數十億歐元。

醜聞的背景是大眾汽車和其他汽車製造商使用了操縱性軟體,該軟體可以檢測車輛的環境合規性測試條件。該軟體演算法改變了發動機的行為,使其在測試條件下排放的汙染物廢氣比正常情況下少。這樣,它就欺騙了測試程式。排放的完全減少僅發生在測試期間,而不是在正常使用中。

在 21 世紀,我們迫切需要解決如何在技術上實施道德標準的問題。

同樣,演算法、計算機程式碼、軟體、模型和資料將越來越多地決定我們在數字社會中看到什麼,以及我們在健康保險、金融和政治方面的選擇是什麼。這給經濟和社會帶來了新的風險。特別是,存在欺騙的危險。

因此,重要的是要理解我們的價值觀體現在我們創造的事物中。否則,未來的技術設計將決定我們社會的形態(“程式碼即法律”)。如果這些價值觀是自私自利的、歧視性的或與自由和個人隱私的理想背道而馳的,這將損害我們的社會。因此,在 21 世紀,我們必須迫切解決如何在技術上實施道德標準的問題。這一挑戰呼籲我們“為價值而設計”。

如果我們缺乏開發必要的技術工具、科學和制度來使數字世界與我們的共同價值觀保持一致的動力,那麼未來看起來將非常黯淡。值得慶幸的是,歐盟已對負責任的創新進行了廣泛的研發計劃投資。此外,透過《隆德宣言》和《羅馬宣言》的歐盟國家強調,創新需要負責任地進行。除其他外,這意味著創新應 направлена на разработку( направлена на разработку - Russian, meaning directed at developing, I will translate to Chinese as “旨在開發”) 智慧解決方案來解決社會問題,這些解決方案可以協調效率、安全性和可持續性等價值觀。真正的創新不涉及欺騙人們相信他們的汽車是可持續和高效的。真正的創新意味著創造能夠真正滿足這些要求的技術。

數字風險素養

技術需要能夠控制它的使用者

與其讓智慧技術削弱我們的腦力,我們應該學會更好地控制它,Gerd Gigerenzer 說——從童年開始。

數字革命提供了令人印象深刻的可能性:數千個應用程式、物聯網以及與世界的幾乎永久連線。但在興奮之中,一件事情很容易被遺忘:創新技術需要有能力的使用者來控制它,而不是被它控制。

三個例子

我的一位博士生坐在他的電腦前,似乎全神貫注於撰寫他的論文。與此同時,他的電子郵件收件箱整天都開著。他實際上是在等待被打斷。透過檢視他的寫作流程,很容易識別出他在一天中被打斷了多少次。

一位美國學生在開車時發簡訊

“當簡訊進來時,我必須看,無論如何。幸運的是,我的手機首先以彈出視窗的形式向我顯示簡訊……所以我開車時不必看太多。” 如果以每小時 50 英里的速度,她只花 2 秒鐘瞥一眼手機,她就“盲開”了 48 碼。這位年輕女性正在冒著發生車禍的風險。她的智慧手機已經控制了她的行為——德國也有 20% 到 30% 的人在開車時發簡訊,情況也是如此。

在 2014 年印度的議會選舉中,這是世界上最大的民主選舉,擁有超過 8 億潛在選民,有三位主要候選人:N. Modi、A. Kejriwal 和 R. Ghandi。在一項研究中,未決選民可以使用網際網路搜尋引擎找到關於這些候選人的更多資訊。然而,參與者不知道網頁已被操縱:對於一組人,關於 Modi 的更多正面條目彈出在第一頁,負面條目稍後出現。其他組對其他候選人經歷了同樣的情況。這種和類似的操縱程式在網際網路上很常見。據估計,對於由於這種操縱而出現在第一頁的候選人,他們從未決選民那裡獲得的選票數量增加了 20 個百分點。

在這些案例中的每一個案例中,人類行為都受到數字技術的控制。失去控制並不是什麼新鮮事,但數字革命增加了這種情況發生的可能性。

我們能做什麼?有三種相互競爭的願景。一種是技術家長主義,它用演算法取代(有缺陷的)人類判斷。心神不寧的博士生可以繼續閱讀他的電子郵件並使用論文寫作軟體;他所需要做的就是輸入關於該主題的關鍵資訊。這種演算法將透過使抄襲醜聞成為日常事件來解決抄襲醜聞這個令人惱火的問題。

儘管仍處於科幻領域,但在許多領域,人類判斷已經被計算機程式所取代。例如,BabyConnect 應用程式跟蹤嬰兒的日常發育——身高、體重、哺乳次數、換尿布次數等等——而更新的應用程式將嬰兒與即時資料庫中其他使用者的孩子進行比較。對於父母來說,他們的寶寶變成了一個數據向量,正常的差異通常會導致不必要的擔憂。

第二種願景被稱為“助推”。與其讓演算法完成所有工作,不如將人們引導到特定的方向,通常是在他們不知情的情況下。印度選舉的實驗就是一個例子。我們知道谷歌搜尋結果的第一頁獲得了大約 90% 的點選量,其中一半是前兩個結果。透過操縱結果的順序,使關於特定候選人或特定商業產品的正面結果出現在第一頁,從而利用了對人類行為的這種瞭解。在像德國這樣的網路搜尋由一家搜尋引擎(谷歌)主導的國家,這導致了左右選民的無限可能性。像技術家長主義一樣,助推接管了舵。

但還有第三種可能性。我的願景是風險素養,讓人們具備控制媒體而不是被媒體控制的能力。一般來說,風險素養涉及以知情的方式處理與健康、金錢和現代技術等風險相關的領域。數字風險素養意味著能夠利用數字技術,而不會變得依賴於數字技術或被數字技術操縱。這並不像聽起來那麼難。我的博士生後來學會了每天只打開三次他的電子郵件帳戶,早上、中午和晚上,這樣他就可以不受持續打斷地撰寫他的論文。

學習數字自控需要從兒童時期開始,在學校也要從父母樹立的榜樣中學習。一些家長式作風者可能會嘲笑這個想法,聲稱人類缺乏智慧和自律,永遠無法成為風險素養者。但是,幾個世紀前,人們也曾說過學習閱讀和寫作——現在工業國家的大多數人都可以做到這一點。以同樣的方式,人們可以學會更明智地處理風險。為了實現這一目標,我們需要徹底反思策略,並將投資於人,而不是用智慧技術取代或操縱他們。在 21 世紀,我們需要更少的家長式作風和助推,以及更多知情、批判性和精通風險的公民。現在是時候從技術手中奪回遙控器,將我們的生活掌握在自己手中了。

倫理:為了共同利益和人類的大資料

資料的力量可以用於好的和壞的目的。Roberto Zicari 和 Andrej Zwitter 制定了大資料倫理的五項原則。

作者:Andrej Zwitter 和 Roberto Zicari

最近,越來越多的聲音——從埃隆·馬斯克(特斯拉汽車公司)等科技遠見卓識者,到比爾·蓋茨(微軟)和史蒂夫·沃茲尼亞克(蘋果)——警告人工智慧 (AI) 的危險。一份反對自動化武器系統的請願書獲得了 20 萬人的簽名,麻省理工學院最近釋出的一封公開信呼籲對即將到來的數字社會採取新的、包容性的方法。

我們必須認識到,大資料與任何其他工具一樣,可以用於好的和壞的目的。從這個意義上說,歐洲法院就人權理由反對安全港協議的決定是可以理解的。

國家、國際組織和私人行為者現在在各個領域使用大資料。所有從大資料中獲利的人都意識到他們的道德責任非常重要。因此,為了傳播大資料使用的道德行為準則,“為了人類的資料倡議”應運而生。該倡議提出了大資料使用者的五項基本倫理原則

1. “不作惡”。每個人現在留下的數字足跡使個人、社會群體和整個社會在一定程度上暴露於透明度和脆弱性之中。那些可以訪問大資料洞察力的人絕不能傷害第三方。

2. 確保以這樣的方式使用資料,即結果將促進人類的和平共處。內容的選擇和對資料的訪問影響著社會的世界觀。只有當資料科學家意識到他們有責任提供均勻和公正的資料訪問時,和平共處才有可能。

3. 使用資料來幫助有需要的人。除了經濟效益外,大資料領域的創新還可以創造額外的社會價值。在全球互聯互通的時代,現在有可能建立創新的大資料工具,這些工具可以幫助支援有需要的人。

4. 使用資料來保護自然並減少環境汙染。大資料分析的最大成就之一是高效流程和協同效應的開發。只有當這些方法也用於創造和維護健康穩定的自然環境時,大資料才能提供可持續的經濟和社會未來。

5. 使用資料消除歧視和不容忍,並建立一個公平的社會共存體系。社交媒體建立了一個加強的社交網路。只有當它建立在公平、平等和正義的原則之上時,才能實現長期的全球穩定。

總而言之,我們還想提請注意大資料提供的新穎可能性如何帶來更美好的未來:“隨著越來越多的資料變得不那麼昂貴,技術打破了獲取和分析的障礙,為公民目的提供可操作資訊的機會也隨之增加。這可以被稱為大資料的‘共同利益’挑戰。”(Jake Porway,DataKind)。歸根結底,重要的是將轉向大資料理解為做好事的機會和對美好未來的希望。

測量、分析、最佳化:當智慧機器接管社會控制時

在數字時代,機器已經在很大程度上控制著日常生活。因此,我們應該三思而後行,然後再分享我們的個人資料,專家Yvonne Hofstetter 說

如果諾伯特·維納(Norbert Wiener,1894-1964)經歷過數字時代,那麼對他來說,這將是富饒之地。“控制論是資訊和控制的科學,無論控制目標是機器還是生物體”,控制論的創始人曾在 1960 年在德國漢諾威解釋道。在歷史上,世界從未產生過像今天這樣多的資料和資訊。

控制論,一門聲稱具有普遍重要性的科學,提出了一個強有力的主張:“一切皆可被控制。” 在20世紀,美國軍隊和蘇聯都應用控制論來控制他們的軍備競賽。 北約部署了所謂的C3I系統(指揮、控制、通訊和資訊),這個術語指的是軍事基礎設施,其語言學淵源可以追溯到維納於1948年出版的著作《控制論:或關於動物和機器的控制與通訊》。 “控制”指的是對機器的控制,也包括對個人或整個社會系統(如軍事聯盟、金融市場,甚至指向21世紀的選民)的控制。 其主要前提是:保持對世界的監視以收集資料。 將人和物連線到萬物互聯是獲取作為控制論控制策略輸入的必要海量資料的完美方式。

維納透過控制論提出了一個新的科學概念:閉環反饋。 反饋——例如我們給出的點贊、我們發表的線上評論——也是數字化的一個重要概念。 這是否意味著數字化是控制論最完美的實現? 當我們使用智慧裝置時,我們正在建立一個 непрерывный 資料流,洩露我們的意圖、地理位置或社會環境。 當我們在網上進行比以往任何時候都更不經思考的交流時,在後臺,一個人工智慧生態系統正在演變。 今天,人工智慧是唯一能夠分析我們並得出關於我們未來行為結論的技術。

一種自動控制策略,通常是學習機器,分析我們的實際情況,然後計算出一種刺激,這種刺激應該引導我們更接近理想的“最佳”狀態。 越來越多的此類控制器支配著我們的日常生活。 作為數字助理,它們幫助我們在浩如煙海的選擇和令人望而生畏的不確定性中做出決策。 甚至谷歌搜尋也是一種控制策略。 當輸入關鍵詞時,使用者會透露他的意圖。 反過來,谷歌搜尋引擎不僅會呈現最佳搜尋結果列表,還會呈現一個連結列表,這個列表更多地體現了對公司而非使用者而言最高的(經濟)價值。 谷歌透過這種方式,即在搜尋結果的最頂端列出企業產品,來控制使用者的下一次點選。 歐盟認為,這是一種濫用。

但是有什麼出路嗎? 是的,如果我們斷開與控制論迴圈的連線。 只要停止響應數字刺激即可。 如果可控的對應物跳出迴圈,控制論就會失效。 然而,我們有自由不回應數字控制器。 但是,隨著數字化的進一步升級,很快我們可能就別無選擇了。 因此,我們被呼籲為我們的自由權利而戰——在數字時代,尤其是在智慧機器興起之際,重新戰鬥。

對於諾伯特·維納(Norbert Wiener,1894-1964)來說,數字時代將是一個天堂。 “控制論是關於資訊和控制的科學,無論被控制的是機器還是生物體,”這位控制論的創始人曾在1960年於德國漢諾威說過。

控制論,一門聲稱具有普遍重要性的科學,做出了一個強有力的承諾:“一切都是可控的。” 在20世紀,美國軍隊和蘇聯都應用控制論來控制軍備競賽。 北約部署了所謂的C3I系統(指揮、控制、通訊和資訊),這個術語指的是軍事基礎設施,其語言學淵源可以追溯到維納於1948年出版的著作,書名為《控制論:或關於動物和機器的控制與通訊》。 “控制”指的是對機器的控制,也包括對個人或整個社會系統(如軍事聯盟、北約和華沙條約組織)的控制。 它的基本要求是:整合、收集資料和溝通。 將人和物連線到萬物互聯是獲取作為控制論控制策略輸入的必要資料的完美方式。

控制論提出了一種新的科學概念:閉環反饋。 反饋——例如我們給出的點贊或我們發表的線上評論——是與數字化相關的另一個重要概念。 這是否意味著數字化是控制論最完美的實現? 當我們使用智慧裝置時,我們建立了一個 непрерывный 資料流,洩露我們的意圖、地理位置或社會環境。 當我們在網上進行比以往任何時候都更不經思考的交流時,在後臺,一個人工智慧(AI)生態系統正在演變。 今天,人工智慧是唯一能夠分析我們並得出關於我們未來行為結論的技術。

一種自動化控制策略,通常是學習機器,分析我們當前的狀態,並計算出一種刺激,這種刺激應該引導我們更接近理想的“最佳”狀態。 越來越多的此類控制器支配著我們的日常生活。 這些數字助理幫助我們在浩如煙海的選擇和令人望而生畏的不確定性中做出決策。 甚至谷歌搜尋也是一種控制策略。 當輸入關鍵詞時,使用者會透露他的意圖。 反過來,谷歌搜尋引擎不僅會呈現最佳搜尋結果的列表,還會呈現一個連結列表,這個列表是根據其對公司而非使用者的(經濟)價值排序的。 透過在搜尋結果的最頂端列出企業產品,谷歌控制了使用者的下一次點選。 歐盟認為,這是對谷歌壟斷地位的濫用。

但是有什麼出路嗎? 是的,如果我們斷開與控制論迴圈的連線,並簡單地停止響應數字刺激。 如果可控的對應物跳出迴圈,控制論就會失效。 即使這很困難,我們也應該對我們的資料保持謹慎和節儉。 然而,隨著數字化的進一步升級,很快可能就沒有更多的選擇了。 因此,我們被呼籲再次為我們在數字時代的自由而戰,特別是要對抗智慧機器的興起。