2015年除夕,紐約州羅切斯特市的當地和聯邦特工逮捕了一名26歲的男子,他計劃當晚稍後用刀和彎刀隨機襲擊人群。就在他被捕之前,伊曼紐爾·L·盧奇曼製作了一段影片,打算在襲擊發生後釋出到社交媒體上,他在影片中宣誓效忠伊拉克和敘利亞的伊斯蘭國(ISIS)。盧奇曼後來表示,他的陰謀的主要靈感來源是類似的支援伊斯蘭國和“暴力聖戰”的影片,這些影片在社交媒體和網站上釋出和分享。

盧奇曼(目前正在服刑20年)特別迷戀安瓦爾·奧拉基的影片,他是一位出生於美國的牧師,也是葉門基地組織招募人員。奧拉基在網上的激烈佈道也被認為是2013年波士頓馬拉松爆炸案以及過去15年中美國和歐洲發生的其他幾起重大恐怖襲擊事件的靈感來源。官員們在盧奇曼被捕前幾天一直在監視他的活動,並在他完成影片製作後立即採取了行動——這段影片從未釋出,諷刺的是,它最終成為了他意圖實施多項犯罪的證據。

然而,在奧拉基這位被戲稱為“網際網路上的本·拉登”的牧師死於美國無人機襲擊五年多後,他的影片仍然在激勵著容易受影響的年輕人。Facebook、Twitter和谷歌的YouTube一直在努力刪除恐怖主義宣傳影片,並關閉與ISIS和其他一些暴力組織相關的賬戶。然而,這些影片已經被複制和分享了很多次,以至於在這些網站上仍然可以被像盧奇曼和奧馬爾·米爾·西迪克·馬丁這樣精通數字技術和容易走向極端的千禧一代廣泛獲取。後者在去年6月在奧蘭多的Pulse夜總會殺害49人之前,曾在社交媒體上宣誓效忠ISIS。

關於支援科學新聞

如果您喜歡這篇文章,請考慮透過以下方式支援我們屢獲殊榮的新聞報道 訂閱。透過購買訂閱,您將幫助確保有關當今世界發現和塑造我們世界的有影響力的故事的未來。

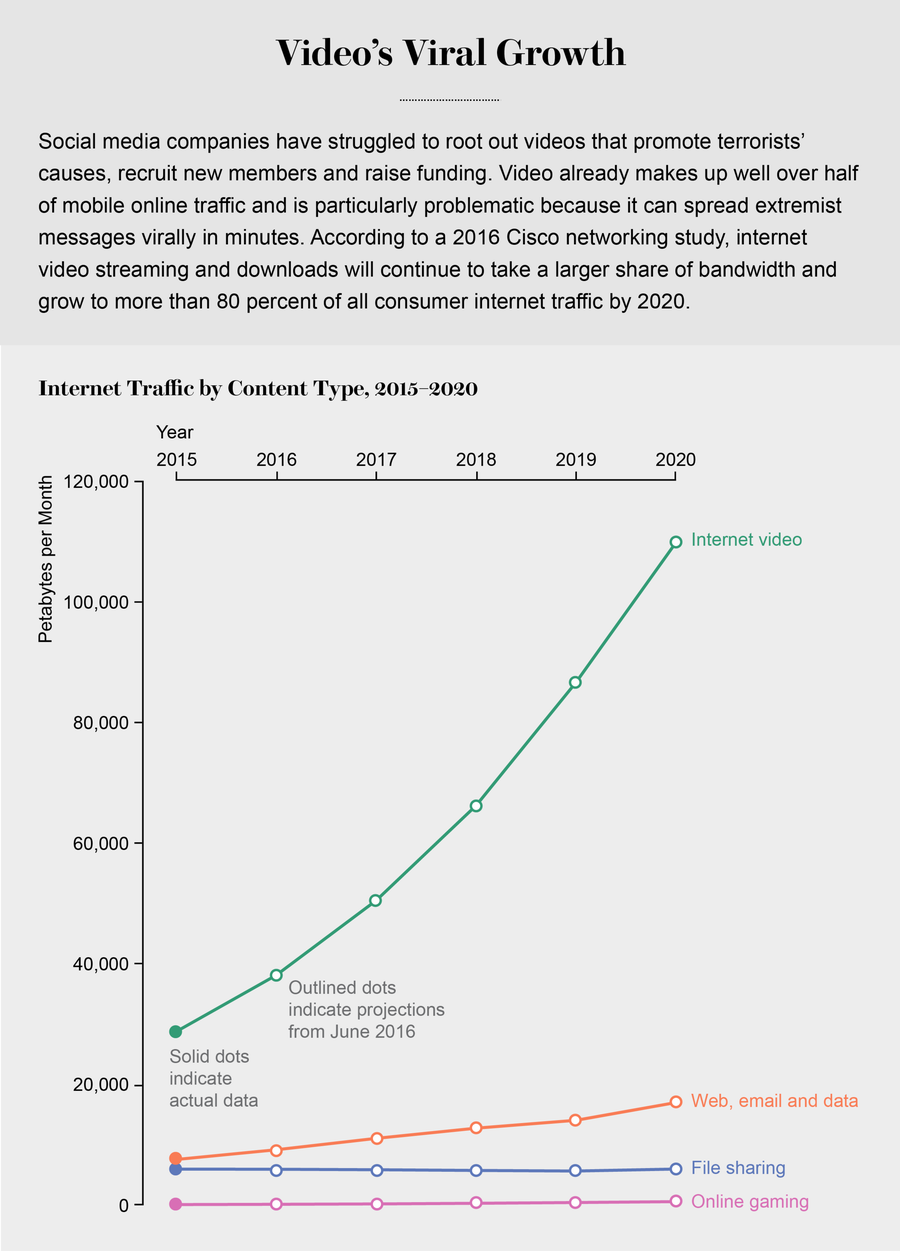

社交媒體公司長期以來一直使用複雜的演算法來挖掘使用者的文字、影像、影片和位置資料,以改進搜尋結果並精確地定位廣告。但是,將類似技術應用於根除宣傳恐怖分子事業、招募新成員和籌集資金的影片的努力卻不太成功。影片佔移動線上流量的一半以上,尤其成問題,因為它可以在幾分鐘內以病毒式傳播極端主義者的資訊,難以追蹤,甚至更難消除。儘管面臨這些引人注目的挑戰,Facebook、谷歌和Twitter正面臨著越來越強烈的抵制——包括廣告商的抵制和訴訟——迫使它們更有效地處理它們所建立的平臺的陰暗面。新的影片“指紋識別”技術正在興起,有望在極端主義影片釋出後立即將其標記出來。然而,仍然存在很大的問題:這些工具是否能夠有效地防止恐怖主義影片在社交媒體上擴散?那些助長了這種宣傳的公司會接受它們嗎?

來源:Amanda Montañez;來源:思科視覺網路指數,2016

社交媒體的ISIS問題

據布魯金斯學會美國與伊斯蘭世界關係專案的前非常駐研究員J·M·伯傑稱,ISIS有一套完善的利用社交媒體和其他線上渠道的策略來吸引新成員,並鼓勵他們代表恐怖組織採取行動。西姆斯·休斯是喬治華盛頓大學極端主義專案副主任,他說:“[ISIS]招募人員的平均年齡約為26歲。這些年輕人不是在學習如何使用社交媒體——他們已經知道如何使用,因為他們是伴隨著社交媒體成長起來的。”

幾年前,ISIS影片在YouTube上成為了一種主要內容,以至於該網站的自動化廣告演算法在與恐怖組織相關的影片前插入了寶潔、豐田和安海斯-布希的廣告。儘管當時谷歌保證正在刪除廣告,並在某些情況下刪除影片本身,但問題遠未解決。3月份,谷歌歐洲、中東和非洲(EMEA)業務和運營總裁馬修·布里頓向包括奧迪、瑪莎百貨和英國麥當勞在內的大型廣告商道歉,這些廣告商在發現他們的線上廣告出現在恐怖組織和白人至上主義者的內容旁邊後,撤回了他們的線上廣告。美國電話電報公司(AT&T)、強生公司和其他主要美國廣告商也出於同樣的原因抵制了YouTube。

谷歌是否對這些內容視而不見是一個有爭議的問題,主要是在該公司和反極端主義專案(CEP)之間,後者是一個非營利性非政府組織,成立於2014年,旨在監測和報告恐怖組織及其支持者的活動。更為確定的是,在谷歌龐大的YouTube網路上,沒有簡單的方法可以找到並刪除所有甚至大部分從僅僅是挑釁性到完全呼籲暴力和仇恨的影片。包括Facebook、谷歌和Twitter在內的社交媒體網站在過去幾年中使用了微軟的PhotoDNA軟體,取得了一些成功,以自動識別他們可能想要刪除的靜態影像——但沒有類似的影片工具。社交媒體網站主要依靠其龐大的使用者群來舉報可能違反公司禁止釋出恐怖主義宣傳政策的影片。Facebook執行長馬克·扎克伯格最近承諾增加3000名稽核員,以幫助更好地監控釋出到該網站的影片,這隻能突顯問題的嚴重性。正如Twitter去年至少在兩篇單獨的博文中指出的那樣,在網際網路上識別恐怖主義言論和招募工作沒有“神奇的演算法”。

影片簽名

這個說法可能不會持續太久。PhotoDNA背後的關鍵研究人員表示,他正在開發一種名為eGLYPH的軟體,該軟體將PhotoDNA的基本原理應用於識別宣傳恐怖主義的影片——即使這些片段經過編輯、複製或以其他方式更改。

大型影片檔案為搜尋工具帶來了“嚴峻的問題”,因為根據質量的不同,它們可能包含每秒24或30個不同的影像,幫助微軟開發PhotoDNA的達特茅斯學院計算機科學教授哈尼·法裡德說,近十年前,微軟開發了PhotoDNA,以打擊網上兒童色情製品。法裡德說,分析影片檔案中單個影像的軟體是不切實際的,因為需要計算機處理能力。他一直在努力開發eGLYPH的演算法一年多,該演算法分析影片、影像和音訊檔案,並建立一個獨特的簽名(稱為“雜湊值”),該簽名可用於識別整個影片或影片中的特定場景。該軟體可以將新發布的線上影片片段的雜湊值與已知宣傳恐怖主義的內容資料庫中的簽名進行比較。如果找到匹配項,則可以自動刪除該新內容,或標記給人工稽核。

eGLYPH的優勢之一是,它無需大量計算能力即可快速建立影片簽名,因為它分析幀之間的變化,而不是每幀中的整個影像。法裡德說:“如果你拍攝一個人的影片,大部分內容都是相同的(從一幀到另一幀)。”這個想法是“將影片提煉到其本質”,僅在幀之間發生重大變化時才做記錄——一個新人進入畫面或相機鏡頭移動到關注新的事物。“我們拍攝這些影片,並嘗試儘可能地刪除資料中的冗餘,並從剩下的資料中提取簽名,”他說。

法裡德在eGLYPH上的合作伙伴是CEP,該組織建立了一個龐大的雜湊影像、音訊檔案和影片儲存庫,“其中包含最糟糕的內容——很少有人會不同意這些內容代表恐怖主義行為、極端主義宣傳和招募材料,”CEP執行長和美國前大使馬克·華萊士說。CEP與《大眾科學》分享的資料庫中的影片片段包括處決(其中幾起是斬首)、爆炸和其他暴力行為。eGLYPH將其生成的簽名與儲存在CEP資料庫中的簽名進行比較。這在原則上類似於PhotoDNA,後者是為了建立和匹配發布在網路上的影像簽名,並將其與美國國家失蹤與受虐兒童中心組織標記為兒童色情製品的資料庫中的影像簽名進行匹配而開發的。

謝謝,但不必了

CEP已向試圖跟上與恐怖主義相關的影片釋出的社交媒體 outlets 提供免費訪問 eGLYPH 和該組織資料庫的許可權。然而,Facebook、Twitter 和 YouTube 拒絕了 CEP 的提議,而是在 12 月宣佈計劃開發他們自己的共享恐怖主義影片雜湊資料庫。即使是為法裡德在 eGLYPH 上的工作提供資金的微軟也選擇加入社交媒體聯盟,並且對其對 eGLYPH 的持續承諾含糊其辭。

根據這些公司 12 月 5 日釋出的聯合宣告,每家社交媒體公司都表示將建立自己的簽名資料庫,用於識別他們從服務中刪除的“最極端和令人髮指的恐怖主義影像和影片”。這些公司尚未透露關於其專案的許多細節,例如如何雜湊釋出到其平臺的新影片,或者如何將這些簽名(他們稱之為“指紋”)與資料庫中儲存的雜湊影片進行比較。每家公司將根據其各自的內容釋出政策,獨立決定是否從其網站和應用程式中刪除被標記的影片。這些公司透過參考其 12 月的新聞稿和釋出在其網站上的其他材料來回應《大眾科學》的採訪請求。

這些公司在清除支援或煽動恐怖主義的影片時採取分散方法的原因之一是,缺乏對“恐怖分子”或“極端分子”內容的普遍定義——社交媒體公司不太可能僅僅依賴反極端主義專案(CEP)或其同行機構的判斷。例如,微軟的政策是從其 Azure 雲託管和其他服務中刪除由聯合國安理會綜合制裁名單上的組織製作或支援的任何內容,該名單包括奧拉基和許多 ISIS 成員。

在 Facebook 上,使用者舉報可能違反該公司規則的內容次數越多,就越有可能引起該公司的注意,該公司應用機器學習主管 Joaquin Candela 在 2 月份在紐約市舉行的 Facebook 人工智慧活動上表示。Candela 沒有具體評論 12 月宣佈的專案,但他表示 Facebook 正在開發人工智慧演算法,該演算法可以分析影片帖子中違反該公司社群標準的內容。建立該演算法的主要挑戰之一是 Facebook 每天收到的帖子數量巨大。據該公司稱,去年,全球 Facebook 使用者每天觀看 1 億小時的影片。另一個挑戰是調整演算法,使其能夠準確識別應刪除的內容,而不會錯誤地標記符合 Facebook 規則的影像和影片。

Twitter 最初僅依靠其使用者來發現每天釋出的數億條推文中可能違反該公司內容釋出規則的推文。然而,對 Twitter 似乎無法控制與恐怖主義相關的推文的批評日益增多,促使該公司採取更積極主動的措施。僅在 2016 年下半年,Twitter 就暫停了 376,890 個帳戶,“原因涉及宣傳恐怖主義”,根據該公司3 月份的“透明度報告”。據該公司稱,被暫停的賬戶中,近四分之三是由 Twitter 的反垃圾郵件工具發現的。

YouTube 的社群準則禁止旨在“招募恐怖組織、煽動暴力、慶祝恐怖襲擊或以其他方式宣傳恐怖主義行為”的影片。但是,該網站允許使用者釋出“旨在記錄與恐怖主義行為相關的事件或關於恐怖主義活動的新聞報道”的影片,前提是這些片段包含“足夠的內容和意圖”。這條細線給任何旨在自動查詢被禁止片段的軟體帶來了困境,這可能解釋了為什麼 YouTube 主要依靠其網站的訪問者來標記不當內容。YouTube 在 2010 年 11 月宣佈,它已刪除了數百個以奧拉基的暴力呼籲為內容的影片,儘管他的許多演講仍然可以在該網站上找到——反極端主義專案在今年 2 月統計出71,400 個帶有他部分言論的影片。

社交媒體公司已經開始接受這樣一種觀念,即他們需要採取更多措施來阻止恐怖主義內容出現在他們的網站上。他們越來越多地增加對影片的禁令,這些禁令是被 YouTube 社群準則禁止的。“其中一些與企業責任有關,但絕大多數可能與公共關係有關,”反極端主義專案的休斯說。公平地說,ISIS 劫持社交媒體的努力造成了這些公司在構建連線朋友和釋出隨機想法的數字平臺時可能沒有預料到的哲學和技術問題,他說。“有一個學習曲線。需要一段時間才能瞭解資訊如何在網上傳播,並找出應該刪除哪些賬戶以及如何刪除它們。”

針對社交媒體的案例

過去一年中針對主要社交媒體公司提起的三個訴訟旨在加速這一學習曲線。這些訴訟涵蓋了馬丁的脈動夜總會襲擊事件,以及 2015 年 11 月巴黎和 2015 年 12 月加利福尼亞州聖貝納迪諾的(pdf)大規模槍擊事件。這些訴訟聲稱,Facebook、Google 和 Twitter“明知且魯莽地”為 ISIS 提供了使用其社交網路作為“傳播極端主義宣傳、籌集資金和吸引新成員的工具”的能力。

Excolo Law——這家位於密歇根州南菲爾德的律師事務所代表恐怖主義受害者的家屬提起訴訟——列舉了襲擊者在襲擊發生之前甚至期間使用社交媒體的具體案例。在丈夫兼妻子賽義德·里茲萬·法魯克和塔什芬·馬利克在聖貝納迪諾殺害 14 人並致傷 22 人,並在他們被執法部門擊斃的期間,馬利克在 Facebook 上釋出了一段影片,表示她效忠 ISIS,根據向加利福尼亞州中部地區美國地方法院提起的訴訟。“如果他們將他們用於定向廣告的十分之一的精力用於阻止恐怖分子使用他們的網站,我們就不會進行這種討論了,”Excolo Law 的首席律師基思·奧特曼說。

《大眾科學》聯絡了 Facebook、Google 和 Twitter,請他們就這些訴訟發表評論。只有 Facebook 回覆說:“我們對受害者及其家人表示同情。我們的社群標準明確表示,Facebook 上不容許從事恐怖主義活動的團體或表達支援此類活動的內容,當此類內容被舉報給我們時,我們會迅速採取行動將其刪除。”

對社交媒體公司反覆出現的批評是,他們對網站上滋生的危險內容反應太慢。“在 2015 年,我們開始與社交媒體公司接觸,說‘存在一個問題,我們認為你們應該採取一些具體步驟來解決它’,”反極端主義專案執行主任 David Ibsen 說。“我們並沒有得到他們最熱情的響應。很多反對意見是,沒有技術解決方案,問題太大了,涉及言論自由問題,這違背了我們自由表達的精神——所有這些不同的事情。”反極端主義專案透過轉向法裡德來挑戰這些藉口。“他說有一種技術解決方案可以解決從網際網路上刪除極端主義內容的問題,而且他一直在研究它,”伊布森說。“這是你第一次聽到一位公認的計算機工程師說科技公司所說的不真實,確實存在技術解決方案。”

未解決的問題

無論反極端主義專案和社交媒體公司是否走到一起,他們正在開發的技術都無法阻止 ISIS 或其支持者在 Facebook Live 或 Twitter 的 Periscope 等服務上直播襲擊或宣傳演講的影片。法裡德說,這樣的影片在資料庫中沒有匹配的簽名,任何標記新影片的嘗試都需要一個定義“恐怖主義”的演算法,以便它知道要查詢什麼。“當我看到它時,我就知道它,”他解釋道。“但我不知道如何為軟體程式定義它,而不會觸發大量的誤報。”在影片中自動識別知名 ISIS 成員面孔的演算法“效果相當好”,但其準確性和速度遠不足以跟上線上傳輸的大量影片,他補充說:“我不認為這個問題會在未來十年內在網際網路規模上得到解決。”Facebook 無法阻止人們透過 Facebook Live 釋出謀殺和自殺的現場錄影,這突顯了法裡德的觀點。

即使主要的社交媒體公司繼續與 eGLYPH 和反極端主義專案保持距離,華萊士仍然希望網際網路服務提供商和較小的社交媒體公司可能仍然對該技術感興趣。“無論如何,我們希望它能成為一個工具,促使人們直面這個問題,”他說。

法裡德承認,減少 ISIS 對社交媒體的使用只是更大規模戰鬥的一部分,這場戰鬥包含許多組成部分——社會經濟、政治、宗教和歷史。“我聽到有人說這個[軟體]不會起任何作用,”他說。“我的回應是:如果你解決問題的標準是,‘要麼我徹底解決問題,要麼我什麼都不做,’那麼我們在任何方面的進步都將完全受到阻礙。”