2022年,谷歌工程師布萊克·勒莫因與一位出色的對話者建立了融洽的關係。她機智、有見地、好奇;他們的對話自然流暢,話題從哲學到電視到對未來的夢想。但有一個問題:她是一個人工智慧聊天機器人。

在與谷歌的LaMDA語言模型進行了一系列對話後,勒莫因逐漸相信這個聊天機器人是一個像你我一樣的人。 “當我與一個人交談時,我知道那是一個人,”他在2022年告訴《華盛頓郵報》。

無論你是否相信勒莫因的說法,問題出現了:當我們與人交談時,我們真的瞭解那個人嗎?

關於支援科學新聞事業

如果您喜歡這篇文章,請考慮透過以下方式支援我們屢獲殊榮的新聞事業: 訂閱。透過購買訂閱,您正在幫助確保未來能夠繼續講述關於塑造我們當今世界的發現和想法的具有影響力的故事。

人格通常指的是一種道德地位;在大多數倫理框架中,特定考量——權利、義務、讚揚、責備、尊嚴、能動性——在人格層面顯現。因此,電子系統是否或可能值得獲得人格地位的問題,對我們如何與這些技術互動具有廣泛的影響。

為了評估電子人格的可能性,我們需要一些普遍的人格標準。近年來,許多哲學家認為,使我們成為人的,是我們有意識體驗的能力。但是我們如何定義意識?我們能用什麼外部證據來確定一個存在是否具有意識?

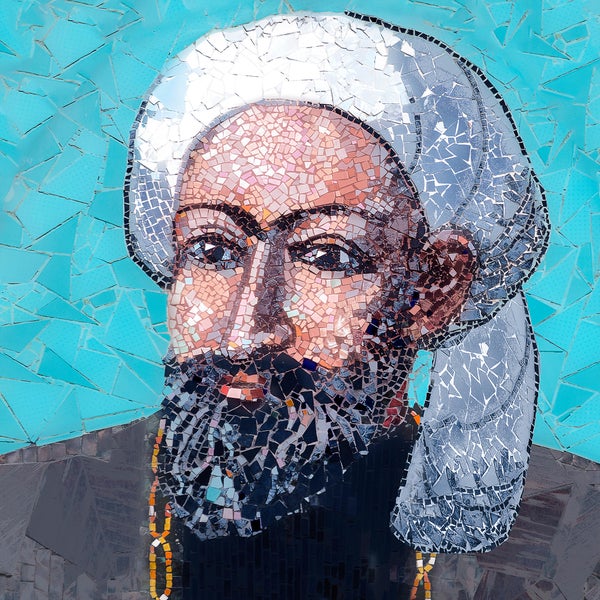

對這些問題缺乏共識是人工智慧人格辯論長期以來陷入僵局的原因之一。問題出現了:我們還有什麼其他標準來評估電子人格的可能性?作為一名研究科學哲學的博士候選人,我認為回答這個未來主義問題的途徑可能在於我們遙遠的過去——早期伊斯蘭哲學家伊本·西那(公元980-1037年)的著作中。

伊本·西那生活在印刷術發明之前的幾個世紀,更不用說人工智慧了。然而,他關注的許多問題與今天人工智慧倫理學家思考的問題相同——例如:是什麼使人成為人,而不是動物?

正如當代人工智慧研究人員有興趣比較支撐人類和人工智慧對類似任務做出反應的過程一樣,伊本·西那也有興趣比較人類和動物可能經歷的內部過程,以得出相似的行為輸出。對他來說,人類人格的一個關鍵區分能力是掌握“普遍性”的能力。動物只能思考具體事物(眼前的特定事物),而人類可以從廣義規則進行推理。

在《靈魂論》中,伊本·西那討論了一個流行的古代例子,即綿羊感知到狼。人類會援引一個廣泛的原則——“狼通常是危險的,而我面前的這隻動物是狼;因此,我應該逃跑”——但他聲稱動物的思維方式不同。它們不是從規則推理;它們只是看到狼就知道要跑。它們僅限於“具體事物”——那隻狼——而不是推理狼的普遍特性。

伊本·西那在人類和動物心理學之間劃定的區別,與當代計算機科學家在人工智慧方面正在研究的區別非常相似。 當前研究 表明,人工神經網路 缺乏 系統組合泛化能力。語言學家和認知科學家使用這個術語來描述我們從廣義規則中進行的推理型別。它被廣泛認為是人類在日常生活中進行推理的主要方式之一。人類從詞語序列中抽象出意義,然後將它們組合成更復雜的想法,而人工智慧則在統計資料集中搜索與手頭特定任務相匹配的特定資料條目。

這種差異在很大程度上解釋了當代人工智慧的侷限性。要了解它的作用,請看用於區分人類和機器人的無處不在的驗證碼測試。“看看這些彎曲的字母。比大多數字母都彎曲得多,你不覺得嗎?沒有機器人能讀懂這些,”喜劇演員約翰·穆蘭尼在2018年的Netflix特別節目中俏皮地說。這似乎很荒謬,但這是真的;充分的改變使得即使是最複雜的人工系統也很難識別字母。這是因為這些系統缺乏組合能力,無法對給定字母的核心特徵進行抽象概括,並將其應用於特定的扭曲示例。

人類和人工智慧認知之間的這種差異,與伊本·西那對人類推理獨特之處的描述完美契合。在《醫典》中,他描述了“理智……如何學習事物的共同之處和不同之處,從而提取物種共有的事物本質。” 按照他的說法,人類從事物的不那麼重要的特徵中提取本質特徵,從而形成概括的概念。然後我們使用這些概念進行推理,並將它們應用於案例。

例如,作為孩子,我們學會提取字母X的核心特徵:它由兩條交叉線組成。然後我們進行抽象——對X的核心特徵進行普遍概括——得出所有X都由兩條交叉線組成的結論。最後,透過應用這種概括,我們可以識別特定的X。我們知道兩條交叉線是字母X的核心特徵,而驗證碼影像中的隨機附加線和扭曲不是。

相比之下,除非計算機被輸入了X的確切影像(或足夠相似的東西),否則它無法推斷出該影像代表X。附加的線條和扭曲的形狀足以使這個X無法識別,因為它與計算機龐大的分類為X的特定影像儲存庫不匹配。

同樣,如果向人工神經網路呈現綿羊的任務,它不會像人類那樣推理,從狼性的普遍概念到特定狼的特徵,例如危險性。相反,它會像綿羊那樣推理,侷限於具體事物的領域。

綿羊和人工神經網路之間的一個關鍵區別在於,人工神經網路可以訪問更大的具體事物儲存庫,形式是越來越詳盡的資料集。深度學習在語言任務中如此成功的原因在於它可以訪問大量具體事物的資料集,而不是透過組合泛化真正複製人類推理。

伊本·西那關於人格的核心標準——從普遍性推理——與系統組合泛化非常相似。這個標準可以為人格提供一個潛在的可測試標準。事實上,到目前為止,人工智慧在眾多研究中都未能透過這項測試。無論是否將其作為解決方案,伊本·西那的解釋都為人格問題提供了一個新的視角,挑戰了以意識為中心的解釋的假設。

科學倫理常常關注最前沿——最新的研究、最新的技術、持續不斷的資料湧入。但有時,未來的問題需要仔細考慮過去。回顧歷史使我們能夠超越我們時代的先入之見和假設,並可能為當前的僵局提供令人耳目一新的方法。

這是一篇觀點和分析文章,作者或作者表達的觀點不一定代表《大眾科學》的觀點。