想象一下,一種武器在發射或扣動扳機時無需人類做出決定。想象一下,一種由人類程式設計來識別人類目標的武器,但隨後卻被留下來掃描其內部資料庫,以決定一組身體特徵是否意味著某人是朋友還是敵人。當人類犯錯,向錯誤的目標開火時,抗議聲震耳欲聾,懲罰也可能很嚴厲。但是,如果一臺被程式設計來控制武器的計算機做出了開火的致命決定,而且它錯了,我們會有什麼反應,我們將追究誰的責任?

這不是電影;這些是代表們在四月份於維也納舉行的自主武器系統會議上考慮的各種問題。在這座以華爾茲舞而聞名的古典歐洲城市中心,當人們接孩子放學和喝咖啡時,專家演講者手持麥克風坐在特殊的高級別小組中,討論著機器的開發和使用可能很快就會變得無法挽回的非常現實的可能性,這些機器被程式設計為獨立判斷誰生誰死。

奧地利聯邦歐洲和國際事務部長亞歷山大·沙倫貝格說:“這是我們這一代人的‘奧本海默時刻’,”“我們不能讓這一時刻白白流逝而不採取行動,現在是就國際規則和規範達成一致以確保人類控制的時候了。”

關於支援科學新聞報道

如果您喜歡這篇文章,請考慮透過以下方式支援我們屢獲殊榮的新聞報道 訂閱。透過購買訂閱,您正在幫助確保有關塑造我們當今世界的發現和想法的具有影響力的故事的未來。

我作為一家日本媒體機構的聯合國記者報道了這些會議,這些關於我們未來的非凡討論與我們當下的平凡時刻並行發生——日本是歷史上唯一遭受過核 бомбардировок 的國家,因此非常感興趣。沙倫貝格的宣告是正確的:迫切需要制定國際規則,以防止這些機器被完全放任,在戰爭中做出生死攸關的決定,這令人沮喪地緊迫。但是,實際的規則制定仍然很少。

第一個“奧本海默時刻”之後的幾十年帶來了一場暗流湧動的冷戰和一個處於災難性核 апокалипсис 邊緣的世界。即使在今天,仍然存在嚴重威脅要使用核武器,儘管它們有能力摧毀文明並導致人類滅絕。我們真的想在其中加入自主武器嗎?我們真的想武裝那些可能將兒童的體溫誤認為士兵的計算機螢幕嗎?我們想生活在一個由機器居住的世界裡,這些機器可能在幾分鐘內選擇大規模 бомбардировать 繁忙的城鎮廣場嗎?立法的時機不是下週、明年、下個十年。就是現在。

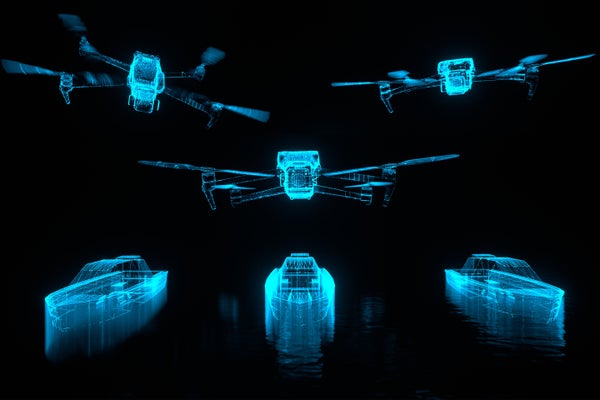

提到“殺手機器人”,你的腦海中會想到《終結者》,但是真正的殺手機器人可能更加隱蔽,偽裝成螢幕上的計算機程式。武器本身可以採取多種形式:無人和潛水無人機;徘徊的“自殺”無人機,它們等待目標,然後猛撲攻擊;具有反車輛和反人員地雷的防禦系統;預程式設計的攻擊導彈、火箭或飛機,它們根據標準打擊目標;甚至用於大規模殺傷的無人機“蜂群”。

這些武器在人類的控制下存在——實際的人決定何時何地使用它們——但是,越來越多的程式設計師正在訓練這些機器在沒有人類按下象徵性的紅色按鈕的情況下做出這些決定。這些機器如何被訓練和測試至關重要。有些人認為,或許仍有機會阻止甚至更致命的自主武器的開發,但是,即使這在某種程度上是可能的,但現在顯然至少需要制定關於其使用的規則。

這些武器甚至不再是未來的問題了;有報道稱,在烏克蘭戰爭中已經使用了完全自主無人機,以色列國防軍(IDF)正在使用一個名為薰衣草的人工智慧驅動的資料庫來追蹤和瞄準哈馬斯成員。我們如何使用自主武器系統,這些決策背後的倫理,以及我們是否監管使用它們,已經成為激烈爭論的地緣政治話題;過去幾年,關注這些問題的會議數量呈指數級增長,例如維也納會議。

世界和平領域的主要參與者已經意識到這些型別武器構成的威脅已有一段時間了。人權觀察(HRW)大聲疾呼制定國際立法,並多次宣告,使用自主武器將“不符合國際人道主義法”。人權觀察還共同創立了一個恰如其名的“停止殺手機器人”聯盟,該聯盟於 2013 年啟動,堅決反對機器“決定誰生誰死”。

去年十月,聯合國秘書長安東尼奧·古特雷斯和紅十字國際委員會(ICRC)主席米里亞娜·斯波利亞里奇共同呼籲各國制定具體的禁止和限制措施,以便“保護今世後代免受其使用後果的影響”。自主武器系統也列入了大會議程,預計將在今年晚些時候的未來峰會上進行討論。

儘管官員們做出了這些英勇的努力和令人望而生畏的奧本海默式宣告,但在立法方面的進展仍然明顯遲緩。

原因是什麼?原因有很多,但有一點是肯定的:應該承擔責任的國家沒有承擔責任。

美國國防部就自主武器發表了宣告,承認其危險性,但尚未透過關於其開發或使用的明確規則,並且在幕後,美國國防部正在悄悄地投資軍事人工智慧和自主武器技術。據報道,截至 2023 年底,五角大樓已經在進行至少 800 個與人工智慧相關的軍事專案,並計劃到 2026 年部署啟用人工智慧的自主軍用車輛,以便跟上中國的技術進步。雖然美國已經發布了公開指令,承認武器被留給其自身程式設計判斷的嚴重性,但這些指令包含漏洞,官員之前的宣告對“適當程度的人類判斷”和其他模稜兩可的措辭的定義含糊不清。2023 年,美國政府提出了一項政治宣言,“以圍繞負責任的行為建立國際共識,並指導各國開發、部署和使用軍事人工智慧。”但是,包括中國、俄羅斯、伊朗和印度在內的其他正在開發或對人工智慧武器表現出興趣的國家尚未簽署。

奧本海默因在製造原子彈後重復引用“我現在成了死神,世界的毀滅者”這句話而聞名。八十年後,核武器依然存在,我們大多數人都不曾知道沒有核武器的世界,而且,按照裁軍的趨勢發展,我們不太可能再次知道。

有了自主武器,我們正處於另一個“世界毀滅者”即將誕生的邊緣。這一次它將是一臺機器。一臺無法感受的機器。一臺不瞭解人性的機器。一臺永遠無法做出真正人類判斷的機器。

技術正在超越立法,並且開始超越全人類。如果不能做更多的事情——現在,在這一刻,由能夠做到的人來做——透過法律和條約來控制這項技術,那麼,還有什麼能阻止一場可怕的殺手機器人軍備競賽,以及致命的自主機器和懸而未決的終結者式戰爭威脅變得正常?如果做得不夠,人類本身難道不會處於崩潰的邊緣嗎?

我們經歷了漫長的時代進化,建立了社會,確立了人權,取得了發現,將人類送入太空,並治癒了一些最致命的疾病。人類,如此聰明,如此受人尊敬,如此遙遙領先。那麼,我們為什麼要做出如此愚蠢的事情,允許機器來判斷我們生命的價值?我們為什麼要冒著最終陷入我們自己不人道的人類創造的混亂之中,在我們自己毀滅的灰燼之中,因為我們賦予了演算法和程式碼終止人類生命的能力?軌跡仍在繼續,除非我們改變它。

這是一篇觀點和分析文章,作者或作者表達的觀點不一定代表《大眾科學》的觀點。