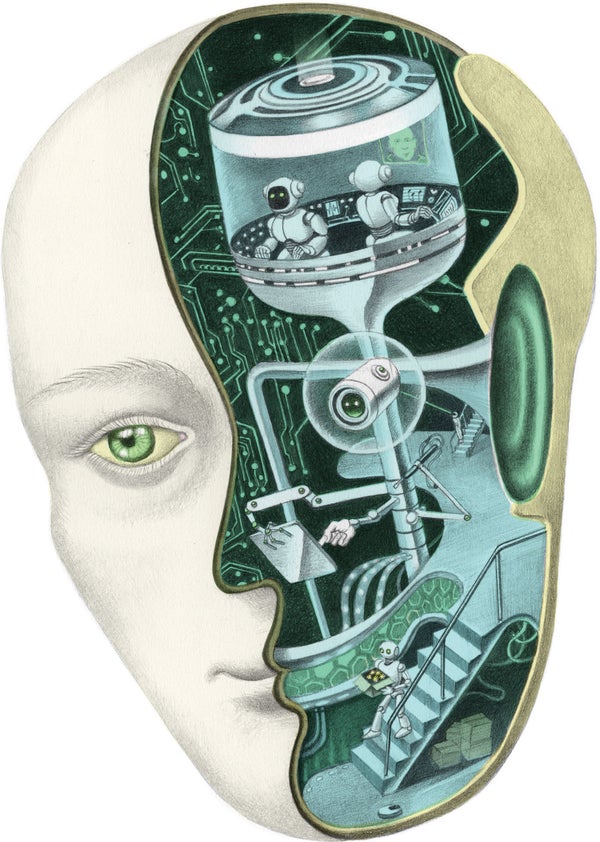

人類是唯一製造機器的動物。透過這樣做,我們將自身的能力擴充套件到生物學極限之外。工具使我們的雙手變得更加多功能。汽車讓我們旅行得更快,飛機賦予我們翅膀。計算機賦予我們更大的大腦和記憶容量,智慧手機協調著日常生活。現在,我們正在創造一種技術,它可以透過將透過資料和努力學習的能力編碼到其中來實現自我進化。它最終會取代我們嗎?還是會增強我們的能力,以前所未有的方式提升我們的人性?

機器學習始於20世紀50年代,先驅科學家弗蘭克·羅森布拉特構建了一個可以學習識別數字的電子神經元,以及阿瑟·塞繆爾,他的跳棋程式透過與自己對弈來學習,直到能夠擊敗一些人類。但直到過去十年,該領域才真正起飛,為我們帶來了自動駕駛汽車、能夠理解我們命令(在一定程度上)的虛擬助手以及無數其他應用。

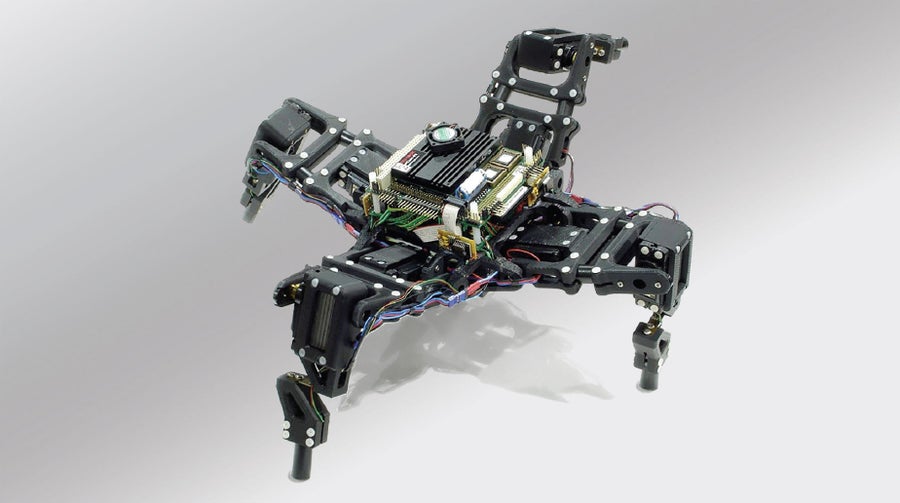

我們每年都會發明數千種新演算法,這些演算法是指示計算機執行操作的指令序列。然而,學習型機器的標誌是,我們不是詳細地對其進行程式設計,而是給它們設定一般目標,例如“學習下跳棋”。然後,像人類一樣,它們透過經驗得到改進。這些學習演算法傾向於分為五個主要類別,每個類別都受到不同科學領域的啟發。毫不奇怪,機器學習的一種方式是透過進化演算法來模仿自然選擇。在哥倫比亞大學的創意機器實驗室,原始機器人嘗試爬行或飛行,效能最佳的機器人的規格會定期混合和變異,以3D列印下一代。從幾乎無法移動的隨機組裝的機器人開始,經過數千或數萬代,這個過程最終產生了諸如機器人蜘蛛和蜻蜓之類的生物。

支援科學新聞事業

如果您喜歡這篇文章,請考慮透過以下方式支援我們屢獲殊榮的新聞事業 訂閱。透過購買訂閱,您正在幫助確保有關塑造我們當今世界的發現和想法的具有影響力的故事的未來。

但進化是緩慢的。深度學習是目前最流行的機器學習正規化,它從大腦中汲取靈感。我們從神經元工作原理的高度簡化的數學模型開始,然後從數千或數百萬個這樣的單元構建一個網路,並透過逐漸加強神經元在檢視資料時一起放電的連線來讓它學習。這些神經網路可以識別面孔、理解語音並以驚人的準確度翻譯語言。機器學習也借鑑了心理學。與人類一樣,這些基於類比的演算法透過在記憶中找到相似的問題來解決新問題。這種能力允許客戶支援的自動化,以及根據您的口味推薦產品的電子商務網站。

機器也可以透過自動化科學方法來學習。為了推匯出一個新的假設,符號學習器會反轉演繹的過程:如果我知道蘇格拉底是人,那麼我還需知道什麼才能推斷出他是必死的?知道人是必死的就足夠了,然後可以透過檢查資料中其他人類是否也是必死的來檢驗這個假設。瑞典查爾姆斯理工大學的生物學家機器人夏娃已經使用這種方法發現了一種潛在的新型瘧疾藥物。夏娃從有關該疾病的資料和分子生物學的基礎知識入手,提出了關於哪些藥物化合物可能有效的假設,設計了實驗來測試它們,在機器人實驗室中進行了實驗,修改或放棄了假設,並重復進行,直到滿意為止。

最後,學習可以完全依賴於數學原理,其中最重要的原理是貝葉斯定理。該定理指出,我們應該根據我們的知識為假設分配初始機率,然後讓與資料一致的假設變得更可能,而與資料不一致的假設變得不太可能。然後,它透過讓所有假設投票來進行預測,更可能的假設權重更大。貝葉斯學習機器在某些醫療診斷方面的準確性超過了人類醫生。它們也是許多垃圾郵件過濾器和谷歌用於選擇向您展示哪些廣告的系統的核心。

這五種機器學習中的每一種都有其優點和缺點。例如,深度學習擅長視覺和語音識別等感知問題,但不擅長獲取常識知識和推理等認知問題。對於符號學習,情況則相反。進化演算法能夠解決比神經網路更難的問題,但解決這些問題可能需要很長時間。類比方法可以僅從少量例項中學習,但在給出關於每個例項的過多資訊時容易感到困惑。貝葉斯學習最適合處理少量資料,但在大資料情況下可能會非常昂貴。

這些令人煩惱的權衡取捨是機器學習研究人員正在努力結合所有正規化最佳元素的原因。就像萬能鑰匙可以開啟所有鎖一樣,我們的目標是建立一個所謂的萬能演算法——一種可以學習從資料中提取的所有內容,從中推匯出所有可能的知識的演算法。

我們現在面臨的挑戰類似於物理學家面臨的挑戰:量子力學在描述最小尺度上的宇宙方面是有效的,而廣義相對論在最大尺度上是有效的,但兩者是不相容的,需要調和。就像詹姆斯·克拉克·麥克斯韋在粒子物理學的標準模型被開發出來之前首次統一了光、電和磁一樣,包括我在華盛頓大學的研究小組在內的不同研究小組已經提出了統一兩種或多種機器學習正規化的方法。由於科學進步不是線性的,而是以斷斷續續的方式發生的,因此很難預測萬能演算法的完全統一何時可能完成。無論如何,實現這個目標不會迎來一個新的、占主導地位的機器種族。相反,它將加速人類進步。

機器接管?

一旦我們獲得了萬能演算法,並將其輸入我們每個人產生的大量資料,人工智慧系統就有可能學習到非常準確和詳細的個人模型:我們的品味和習慣、優點和缺點、記憶和願望、信仰和個性、我們關心的人和事,以及我們在任何給定情況下會如何反應。對我們的模型基本上可以預測我們將做出的選擇,這既令人興奮又令人不安。

許多人擔心,具有這些能力的機器會利用它們新獲得的知識來奪走我們所有的工作,奴役我們,甚至消滅我們。但這不太可能發生,因為它們沒有自己的意志。基本上,所有人工智慧演算法都由我們程式設計的目標驅動,例如“找到從酒店到機場的最短路線”。這些演算法與普通演算法的區別在於,它們在弄清楚如何實現我們為它們設定的目標方面具有很大的靈活性,而不需要執行預定義的步驟序列。即使它們隨著經驗的積累而變得越來越擅長這項任務,目標仍然不變。不朝著目標取得進展的解決方案會自動被丟棄。此外,人類可以檢查機器產生的東西是否確實滿足我們的目標。我們也能夠驗證機器是否違反了我們對它們施加的任何約束,例如“遵守交通規則”。

然而,當我們設想人工智慧時,我們傾向於將諸如意志和意識之類的人類品質投射到它身上。我們大多數人也更熟悉類人人工智慧,例如家用機器人,而不是在幕後工作的無數其他型別。好萊塢透過將機器人和人工智慧描繪成偽裝的人類來加劇這種看法——這是一種可以理解的策略,它使故事更引人入勝。人工智慧只是解決難題的能力——這項任務不需要自由意志。它不太可能反過來對付我們,就像你的手不太可能打你一樣。像任何其他技術一樣,人工智慧將永遠是我們自身的延伸。我們能夠使它們變得越強大越好。

智慧機器人:這隻海星使用進化演算法來學習如何模擬自身。這些演算法是一種機器學習型別,可以與其他演算法統一到一個“萬能演算法”中,這是一種非常強大的人類工具。 來源:Victor Zykov 和 Josh Bongard

那麼,我們的人工智慧驅動的未來會是什麼樣子呢?智慧機器確實會取代許多工作,但對社會的影響可能類似於以前的自動化形式。兩百年前,大多數美國人是農民。然而今天,機器已經取代了幾乎所有農民,而沒有造成大規模失業。末日預言家認為這次不同,因為機器正在取代我們的大腦,而不僅僅是我們的體力,這使得人類無事可做。但是,人工智慧能夠完成我們能夠完成的所有任務的那一天仍然非常遙遠,即使它真的會到來。在可預見的未來,人工智慧和人類將擅長不同的事情。機器學習的主要影響將是大大降低智慧的成本。這種民主化將增加智慧的經濟可行用途的多樣性,創造新的工作崗位,並將舊的工作崗位轉變為用相同數量的人力完成更多的工作。

然後是未來學家雷·庫茲韋爾推廣的“奇點”情景。這是一種不斷加速的技術進步:機器學習製造更好的機器,而更好的機器反過來又製造出更好的機器,依此類推。但我們知道這種情況不可能永遠持續下去,因為物理定律嚴格限制了即使是量子計算機也可能有多強大,而且在某些方面,我們離達到這些限制已經不遠了。人工智慧的進步,就像其他一切進步一樣,最終會趨於平緩。

未來學家中流行的另一種願景是,我們的計算機模型將變得如此之好,以至於它們實際上與真實事物無法區分。在這種情景中,我們可以將自己上傳到雲端,並作為軟體片段永遠存在下去,擺脫物理世界的煩人約束。這種情景的一個問題是,它可能在生物學上不可行。要上傳你自己,你大概需要一個準確的你每個神經元的模型,連同它們儲存的記憶。它必須被如此可靠地捕獲,以至於模型的預測不會迅速偏離真實神經元的行為——這確實是一個艱鉅的任務。

但即使這是一個現實的選擇,如果你有機會,你真的會上傳你自己嗎?你如何才能確定你的模型沒有遺漏你的一些基本部分——或者它根本就沒有意識?如果一個小偷以最絕對和最完整的意義上偷走了你的身份怎麼辦?我相信人們會選擇儘可能長時間地堅持他們糊狀的、碳基的自我——計算機科學家開玩笑地稱之為“溼件”——然後就此罷休。

尋找人類

人工智慧——尤其是機器學習——實際上只是人類進化的延續。在《延伸的表型》中,理查德·道金斯展示了動物的基因如何控制其身體以外的環境,從杜鵑蛋到海狸水壩,這是多麼常見。技術是人類延伸的表型,而我們今天正在構建的是我們技術外骨骼的另一層。我認為人類使用人工智慧的最有可能的場景比通常的推測更令人著迷。

在十年左右的時間裡,我們每個人都可能會有一個“數字替身”,這是一個人工智慧伴侶,它將比我們今天的智慧手機更加不可或缺。您的數字替身不需要與您一起物理移動;很可能它會像您的許多資料已經存在的那樣,生活在雲端的某個地方。我們可以在諸如 Siri、Alexa 和 Google Assistant 等虛擬助手中看到它的開端。您的數字替身的核心將是您的模型,該模型是從您與數字世界互動中生成的所有資料中學習而來的,從臺式電腦和網站到可穿戴裝置和環境感測器,例如智慧揚聲器、恆溫器、手機訊號塔和攝像機。

我們的學習演算法變得越好,我們向它們提供的個人資料越多,我們的數字替身就會變得越準確。一旦我們擁有了萬能演算法,然後將其與透過增強現實頭戴裝置和其他個人感測器連續捕獲的您的感覺運動流相結合,您的替身就會成長為比您最好的朋友更瞭解您。

模型和資料將由“資料銀行”維護,這與儲存和投資您資金的傳統銀行沒有什麼不同。許多現有公司肯定很樂意為您提供該服務。谷歌聯合創始人謝爾蓋·布林曾表示,谷歌希望成為“你大腦的第三部分”,但你可能不希望你大腦的一部分透過向你展示廣告來維持生存。您最好由一家利益衝突較少的新型公司或您與志同道合的人組成的資料聯盟來為您服務。

畢竟,對人工智慧的中心擔憂不是它會自發地變成邪惡,而是控制它的人類會濫用它(cherchez l’humain,正如法國人可能會說的那樣——“關注人類”)。因此,您的資料銀行的首要職責是確保您的模型永遠不會被用來損害您的利益。您和資料銀行都必須警惕監控人工智慧犯罪,因為這項技術將像任何人一樣賦予壞人權力。我們將需要人工智慧警察(威廉·吉布森在他的 1984 年著作《神經漫遊者》中稱之為圖靈警察)來抓捕人工智慧罪犯。

如果您不幸生活在專制政權下,這種情況可能會帶來前所未有的危險,因為它將使政府能夠以前所未有的方式監控和約束您。鑑於機器學習的進展速度以及已經使用的預測性警務系統,少數派報告情景——在人們即將犯罪時對其進行先發制人的逮捕——不再顯得牽強。然後是隨著世界適應數字替身的生活節奏而產生的不平等影響,在我們所有人都有能力負擔得起數字替身之前。

作為個人,我們的首要職責將是不變得自滿,並且不要過分信任我們的數字替身。從外部來看,人工智慧可能看起來是客觀的,甚至是完美的,但從內部來看,它們與我們一樣有缺陷,甚至更多,只是方式不同。例如,人工智慧缺乏常識,並且很容易犯下人類永遠不會犯的錯誤,例如將過馬路的人誤認為是隨風飄動的塑膠袋。它們也容易過於字面地理解我們的指示,給我們我們所要求的,而不是我們真正想要的。(因此,在告訴您的自動駕駛汽車不惜一切代價準時送您到機場之前,請三思而後行。)

實際上,您的數字替身將與您足夠相似,可以在各種虛擬互動中取代您。它的工作不是為您生活,而是為您做出所有您沒有時間、耐心或知識做出的選擇。它將閱讀亞馬遜上的每一本書,並推薦您最有可能想自己閱讀的幾本書。如果您需要汽車,它將研究各種選擇並與汽車經銷商的機器人討價還價。如果您正在找工作,它將為所有符合您需求的職位進行自我面試,然後為您安排最有希望的職位的現場面試。如果您被診斷出患有癌症,它將嘗試所有潛在的治療方法,並推薦最有效的方法。(讓您的數字替身參與醫學研究也是您的道德責任。)如果您正在尋找浪漫伴侶,您的替身將與所有符合條件的替身進行數百萬次虛擬約會。在網路空間中一見鍾情的配對可以然後在現實生活中約會。

本質上,您的替身將在網路空間中度過無數種可能的生活,以便您在物理世界中度過的唯一一種生活很可能是最好的版本。您的模擬生活是否在某種程度上是“真實的”,以及您的網路自我是否具有某種意識(正如某些黑鏡劇集的情節所描繪的那樣)是有趣的哲學問題。

有些人擔心這意味著我們將生活的控制權交給了計算機。但實際上,這給了我們更多的控制權,而不是更少,因為它使我們能夠做出以前無法做出的選擇。您的模型還將從每次虛擬體驗的結果中學習(您喜歡這次約會嗎?您喜歡您的新工作嗎?),以便隨著時間的推移,它將更擅長建議您自己會選擇的東西。

事實上,我們已經習慣於我們的大部分決策都是在沒有我們有意識的干預下發生的,因為這就是我們現在的大腦所做的事情。您的數字替身將像一個大大擴充套件的潛意識,但有一個關鍵區別:您的潛意識獨自生活在您的頭骨內,而您的數字替身將不斷地與其他人和組織的潛意識互動。每個人的替身都將不斷嘗試學習彼此的模型,它們將形成一個模型社會,以計算機速度生活,向各個方向擴充套件,弄清楚如果我們在那裡我們會做什麼。

我們的機器將成為我們的偵察兵,為我們個人和作為一個物種開闢通往未來的道路。它們將把我們引向何方?我們將選擇去哪裡?